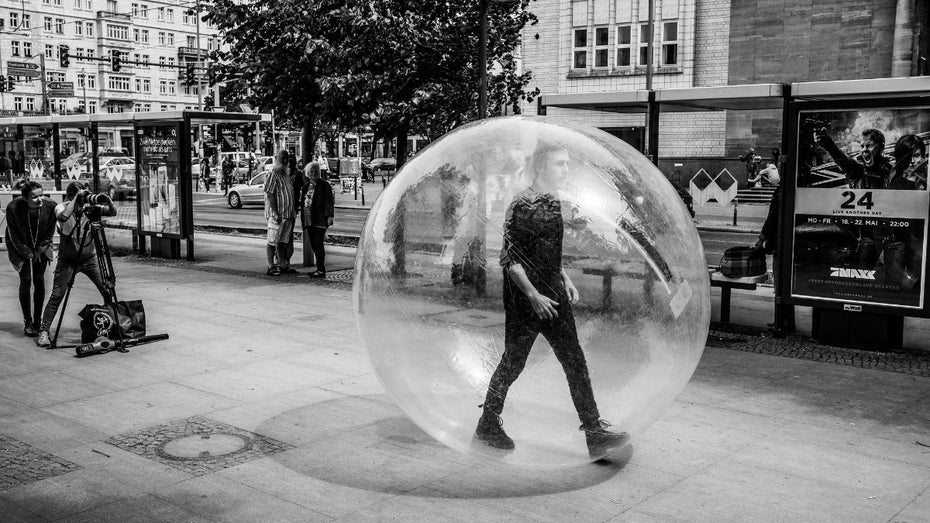

Von wegen Algorithmen: Unsere Filterblasen sind pure Handarbeit

(Foto: Mario Sixtus)

„Oh wie trübe und reizlos wird das Leben für sie werden, ohne mich!? Wie können sie leben in dieser Welt“, jammert Nero, den Dolch zum Suizid in der Hand. Währenddessen stürmt das Volk Roms den kaiserlichen Palast, ganz offensichtlich weit davon entfernt, die Aussicht auf ein Leben ohne Nero als trübe und reizlos zu empfinden.

Zwei Stunden und siebenundreißig Minuten hat der Zuschauer des Ostersonntag-Fernsehklassikers „Quo Vadis“ bis zu diesem Moment dabei zugesehen, wie Peter Ustinov in der Rolle des römischen Kaisers Nero in einem zuckerwattigen Palastkosmos vor sich hinherrscht; eine Umgebung, in die nur Informationen vordringen dürfen, welche die Überzeugungen des Imperators stützen: Claqueure, die seine Dichtkunst loben, Höflinge, die ihm die Bewunderung des Volkes versichern, Boten aus fernen Ländern, die von Heldentaten der Armeen künden. Sogar die Götter sind dem Herrscher wohlgesonnen – beteuern die Priester. Widerspruch, Zweifel, Kritik, unerwünschte Fakten und lästige Paradoxien müssen draußen bleiben. Überbringer widriger Nachrichten lässt der Kaiser umbringen. Ein hermetisches Weltbild fordert eben Opfer.

Solch eine sich selbst bestätigende Wunschwelt aufrecht zu erhalten ist damals eine blutige und aufwändige Angelegenheit. Nur die herrschende Elite kann sich eine derart rosinengepickte Realität leisten, in die nichts einsickert, was den eigenen Standpunkt auch nur anrempeln könnte.

Fast forward: Rund zweitausend Jahre später kann sich ungefähr jeder Zeitgenosse ein völlig eigenes faktenresistentes Weltbild zulegen – und das sogar ganz ohne irgendwelche Boten zu meucheln. „Filterbubble“ nennt dieses Prinzip der Feuilleton-gefütterte Bildungsbürger, meist mit leicht spitzfingerigem Tonfall – in etwa so, wie er auch „Hauptschulabschluss“ betont – und meint damit natürlich nicht das eigene FAZ-zentrische Informationsverhalten, sondern das der gemeinen Netzbewohner.

Der amerikanische Rechtswissenschaftler und Politik-Aktivist Eli Pariser erwähnte den Begriff Filterbubble erstmals in einem New-York-Times-Artikel im Jahr 2011, und er wollte damit auf die Gefahren hinweisen, dass Individualisierungstechniken von Suchmaschinen den Nutzern irgendwann mal keine anderen Sichtweisen mehr präsentieren, außer den eigenen – ein überwiegend theoretisches Gedankenexperiment.

Vom Gedankenexperiment zum Lieblingsthema

Seitdem ist die Filterblase hauptsächlich ein Lieblingsthema der bereits erwähnten bürgerlichen Feuilletons, um immer wieder technologiepessimistische Texte darum herum zu basteln. Irgend ein Morozov oder Lanier findet sich schließlich immer, um einen unheilvollen Refrain dazu zu raunen.

Innerhalb meiner eigenen Filterbubble hingegen wurde die Existenz von Filterbubbles lange vehement bestritten.

Das ist jetzt nicht mehr so.

Allerspätestens mit dem Auftauchen der *gida-Gruppen und den dazugehörigen „Lügenpresse“-Chören sind Filterblasen kein theoretisches Phänomen und kein lustiges Gedankenspiel von Republica-Besuchern mehr, sondern Realität im Netz und auf der Straße.

Der Wissenschaftler Gerret von Nordheim hat die Twitterströme rund um den Münchner Amoklauf am Olympia Einkaufszentrum analysiert und dabei eindeutig eine Gruppe Filterblasenbewohner identifiziert. In den rund 85.000 untersuchten Tweets fand von Nordheim zwei Hauptcluster. Einer formierte sich rund um den Account der Münchner Polizei. Er enthielt überwiegend Tweets von klassischen Nachrichtenmedien wie Spiegel Online, Tagesschau, Zeit Online, ZDFheute, usw. Auch dort zu finden: viele Journalisten, die privat twitterten, sowie einige Politiker. Im zweiten, etwas kleineren Cluster fanden sich diverse AfD-Ortsverband-Twitterer und etliche Privatleute. Der Tweet mit der größten Reichweite innerhalb dieses Clusters lautete „Deutschland im Visier des islamistischen Terrors! Nun muss das deutsche Volk für die Fehler der Regierung Merkel bluten“ und stammt von einem AfD-Account.

Wir erinnern uns: Es gab während des Amoklaufs niemals auch nur dürftige Hinweise darauf, dass der Täter mit islamistischem Hintergrund unterwegs war. Solche Fakten allerdings waren dem zweiten Twitter-Cluster völlig egal: Hier schimpften Twitterer über Medien- und Politik-Versagen, hetzten gegen Moslems und erklärten Flüchtlinge zu Terroristen. Wechselwirkungen, Retweets, Antworten zu dem ersten, nachrichtlichen Cluster gab es kaum. Was aber diese Filterbubble endgültig eine geradezu Nero-esque Qualität verleiht: Das Verhalten der AfD-nahen Twitterer änderte sich auch dann nicht, als längst bekannt war, dass der Mörder ein verstörter deutscher Jugendlicher mit rassistischen Tendenzen war – und somit alles andere als ein islamistischer Terrorist. In dieser Blase waren immer noch Merkel, der Islam an sich und irgendwie auch alle Flüchtlinge die wahren Münchner Massenmörder.

Die Ursachen des Phänomens

Wissenschaftler sehen bei diesem Phänomen zwei Ursachen am Werk: Zum einen den so genannten Bestätigungsfehler, also die Tendenz der menschlichen Wahrnehmung, Informationen zu bevorzugen, die den eigenen Überzeugungen und Hypothesen entsprechen. Was nicht ins persönliche Weltbild passt, muss gelogen sein, oder mindestens ein Irrtum. Zum Zweiten den Effekt der Gruppenpolarisierung, also einer Art getwittertem Permanent-Schulterklopfen und -Kopfnicken. So falsch kann die eigene Weltsicht ja wohl nicht sein, wenn sie ständig, Tweet für Tweet bestätigt wird!

Beide Verhaltensmuster sind natürlich nicht neu. Auch in der Ära der Papiermedien konnte man sich Publikationen zusammensuchen, die ausschließlich die eigene Position fütterten. Das war aber ungleich schwieriger, und: Je abwegiger die Überzeugungen, um so dünner war das mediale Futter. Anhänger der Chemtrail-Theorie, die bekanntlich besagt, die Flugzeug-Kondenzstreifen am Himmel seien in Wahrheit Gift/Chemie/klimaveränderndes Zeugs, konnten auch vor 20 Jahren zwei, drei Bücher erstehen, die diese, äh, These stützten. Dann war aber Schluss. Vermutlich ließ man solcherlei Theorien also irgendwann aus Langeweile zu Hause im Regal verstauben. Anders heute: In Facebook-Gruppen, über Twitter, über Youtube-Channels kann man Unterfütterungen für die absurdesten Weltbilder einsammeln – und zwar reichlich und jeden Tag neu. Langeweile kommt da nicht auf.

Ähnlich sieht es mit dem Bestätigen in und aus der Gruppe aus. War man vor 20 Jahren vielleicht noch der einzige wirrköpfige Chemtrail-Dozent in der Dorfkneipe, so ist man heute der einzige wirrköpfige Chemtrail-Dozent in der Dorfkneipe, der außerhalb der Dorfkneipe 2.000 Twitter-Follower und eine 500-köpfige Facebook-Gruppe hat, deren Mitglieder einem ständig positive Verstärker senden.

Die Algorithmen sind nicht schuld

Filterblasen – im übertragenen Sinne – sind inzwischen Alltag. (Foto: Mario Sixtus)

Die besagten technologiepessimistischen Feuilletons suchen in ihren technologiepessimistischen Artikeln die Ursachen für die zunehmende Filterbubbelei aufgrund ihrer technologiepessimistischen Sichtweise naturgemäß an der falschen Stelle: im Zweifelsfall sind für sie immer böse Algorithmen aus US-amerikanischer Internet-Konzern-Fertigung Schuld an ungefähr allem digitalem Übel. Ein typischer Fehlschluss, der häufig in technologiepessimistischen Filterbubbles entsteht.

Weder Facebooks Sortier-Ranking „Edge“ noch Googles Versuche der individualisierten Ergebnisausgabe kleben die Filterblasen dicht. Die Bubbles sind pure Handarbeit. Algorithmen sind bislang schlicht zu dumm für die Herstellung solch filigraner Filtergebilde und werden das auf absehbare Zeit auch bleiben. Sogar biologischen Netznutzern bleiben Ironie, Sarkasmus, Doppeldeutigkeiten und Wortspiele schließlich oft genug verschlossen. Bis irgendwann irgendein Stück Software die Satzbausteine eines Martin Sonneborn von denen eines Guenther Oettinger unterscheiden kann, wird noch so manche Ode ans brennende Rom gedichtet.„Algorithmen sind zu dumm für die Herstellung von Filterbubbles.“

Als Demokrat, als Freund der Aufklärung und des zivilisatorischen Fortschritts kann die Vorstellung einer komplett zerbubbelten Gesellschaft ein mittelschweres Gruseln auslösen. Wie ließe sich ein wenigstens noch rudimentärer Wertekonsens aushandeln, wenn jeder eine zusammengesammelte Tüte Faktoiden mit zu den Verhandlungen bringt? Und dazu einen Container an persönlich zusammengeklebten Interpretationen dieser Wahrheitsscherben?

Follow, unfollow, subscribe, unsubscribe, block and again: Filterbubbles sind handgefertigt, mit Hilfe digitaler Werkzeuge zwar, aber in höchstindividueller Manufaktur. Und das macht die ganze Angelegenheit viel schwieriger als wären die Blasen made in Silicon Valley oder sonstwo. Die Kunst des Blasenbastelns ist nämlich praktisch identisch mit der Kunst des Informationsmanagements im 21. Jahrhundert. Wer seine Nachrichtenfeeds sortiert, seine Expertenbookmarks sammelt, Menschen und Medien folgt, denen er vertraut, Trolle und Hater blockt, sich Communities sucht, die seinen Interessen entsprechen, der kann sich mit genau den gleichen Handlungen eine wunderhübsch kuschelig-dichte Blase basteln – einfach, in dem er all das übertreibt.

Auch in der persönlichen Informationsökonomie gilt also Paracelsus’ „Nur die Dosis macht das Gift.“ Und wie bei Alkohol und Netflix-Serien ist das richtige Dosieren ein immer wieder aufs Neue schwieriges Projekt. Die unspektakuläre und unbequeme Lösung lautet: Selbstkontrolle, Selbstkritik, Selbsthinterfragung – was zu dem amüsanten Paradoxon führt, dass man mitunter intern genau das selbst erledigen muss, was man mühsam extern herausgefiltert hat.

Bei Nero klappt das auch ganz am Ende des Films nur so mittel: „Ich wollte niemals ein Scheusal sein, die Götter wollten es“, klagt er. Der Filter hält.

Mehr zum Thema Facebook: Facebook: Wie das soziale Netzwerk nerviges Clickbait unterbinden will

Bitte beachte unsere Community-Richtlinien

Wir freuen uns über kontroverse Diskussionen, die gerne auch mal hitzig geführt werden dürfen. Beleidigende, grob anstößige, rassistische und strafrechtlich relevante Äußerungen und Beiträge tolerieren wir nicht. Bitte achte darauf, dass du keine Texte veröffentlichst, für die du keine ausdrückliche Erlaubnis des Urhebers hast. Ebenfalls nicht erlaubt ist der Missbrauch der Webangebote unter t3n.de als Werbeplattform. Die Nennung von Produktnamen, Herstellern, Dienstleistern und Websites ist nur dann zulässig, wenn damit nicht vorrangig der Zweck der Werbung verfolgt wird. Wir behalten uns vor, Beiträge, die diese Regeln verletzen, zu löschen und Accounts zeitweilig oder auf Dauer zu sperren.

Trotz all dieser notwendigen Regeln: Diskutiere kontrovers, sage anderen deine Meinung, trage mit weiterführenden Informationen zum Wissensaustausch bei, aber bleibe dabei fair und respektiere die Meinung anderer. Wir wünschen Dir viel Spaß mit den Webangeboten von t3n und freuen uns auf spannende Beiträge.

Dein t3n-Team

Danke. Mein Gedanke ist immer: so lange ich bei Amazon die Sachen beworben bekomme, die ich gerade erstanden habe, kann es noch nicht so schlimm sein. Oder Netflix: sehe ich einen SciFi-Film, bekomme ich jeden Schund angeboten, der entfernt was mit Zukunft zu tun hat.

Eine ergänzende Überlegung: ob die Algorithmen mal so gut werden bzw. schon gut genug sein könnten (von sprachlichen Sonderfällen wie Ironie mal abgesehen), ein heterogenes Bild zur eigenen Interessenslage zu bieten, ist, vielleicht gar nicht so wichtig, weil die Betreiber daran gar nicht interessiert sind. Die Beschreibung „kuschelige“ Filterblase zeigt es schon, wenn der Nutzer „unbequeme“ Positionen auch angezeigt bekommt, könnte er ja zu einem Anbieter wechseln wollen, der ihn davor bewahrt (es gibt ein ähnliches Problem bei der KI in Videospielen: alle beschweren sich, dass diese dumm und durchschaubar sei und sich seit Jahren nicht weiterentwickelt. Es könnte aber gut sein, dass eine gute KI dem eigentliche Zweck des Spielens, der Unterhaltung, abträglich ist, wenn sie weniger durchschaubar und tatsächlich herausfordernd wäre).

Kleine Ergänzung noch: es ist der Konden-s-streifen (von kondensieren, nicht Kondolenz;).