Gefährliches Spiel: Eine KI hat gelernt, Kriminelle anhand von Fotos zu erkennen

(Bild: Shutterstock.com)

KI lernt, Kriminelle von Nichtkriminellen zu unterscheiden

Schon in der Antike hat man versucht, aus dem physiologischen Äußeren des Körpers, insbesondere des Gesichts, auf seelische Eigenschaften zu schließen. Die sogenannte Physiognomik wurde im 18. und 19. Jahrhundert wieder aufgegriffen, etwa von dem Arzt Cesare Lombroso, der mithilfe seiner Schädelkunde potenzielle Verbrecher vorab erkennen wollte. Lombrosos rassistische Hypothesen wurden schließlich von den Nationalsozialisten verwendet, die damit ihr Eugenik-Programm pseudowissenschaftlich unterfütterten. Das alles sollte man im Hinterkopf haben, wenn man sich die aktuelle Errungenschaft zweier Forscher anschaut.

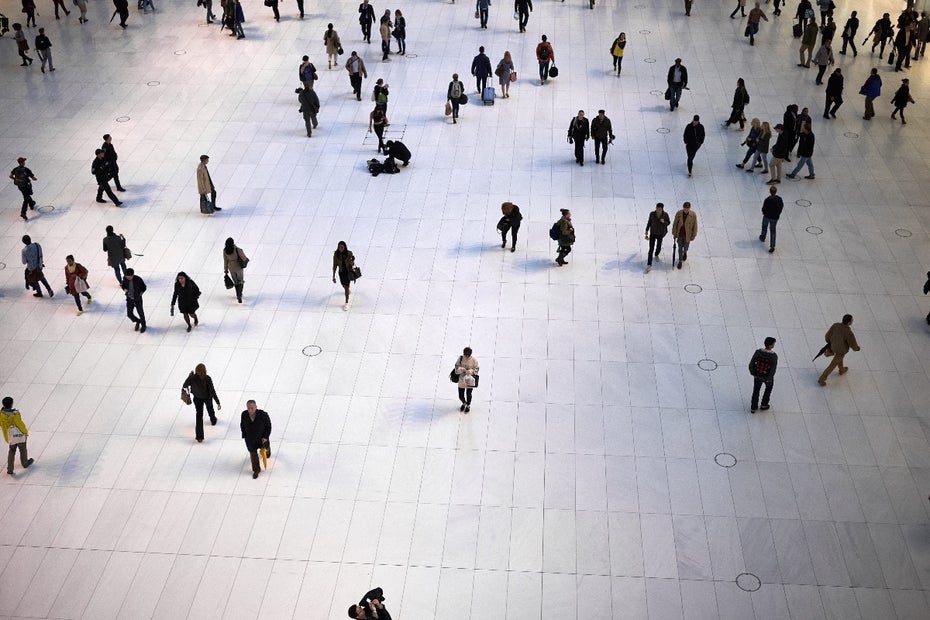

Ethische Streitfrage: Ob eine KI bald Kriminelle in einer Menschenmenge identifizieren soll? (Bild: Shutterstock.com)

Xiaolin Wu und Xi Zhang von der Jiao Tong University in Shanghai haben mithilfe von Machine-Learning einer Künstlichen Intelligenz (KI) beigebracht, Kriminelle anhand von Fotos zu erkennen. Insgesamt wurden dafür 1.856 Bilder von chinesischen Männern im Alter zwischen 18 und 55 Jahren ohne Gesichtsbehaarung verwendet. Die Hälfte dieser Männer waren Kriminelle. 90 Prozent der Bilder wurden genutzt, um das neuronale Netzwerk zu trainieren, die restlichen zehn Prozent anschließend zum Testen verwendet.

Das Ergebnis ist aus ethischer Sicht beunruhigend: Die KI konnte Kriminelle von Nichtkriminellen mit einer Genauigkeit von 89,5 Prozent unterscheiden. Den Forschern zufolge beweise das, dass eine automatisierte gesichtsinduzierte Schlussfolgerung auf Kriminalität trotz der historischen Kontroverse um das Thema möglich sei.

KI findet Unterschiede in den Gesichtszügen

Ihren Untersuchungen zufolge gebe es drei verschiedene Gesichtszüge, die auf darauf hindeuten, dass jemand kriminell ist: Die Krümmung der Oberlippe soll bei Kriminellen im Durchschnitt 23 Prozent größer sein als bei Nichtkriminellen. Zudem soll der Abstand zwischen den beiden inneren Ecken der Augen um sechs Prozent kürzer und der Winkel zwischen zwei Linien von der Spitze der Nase zu den Ecken des Mundes um 20 Prozent kleiner sein. Insgesamt hätten die Gesichter von Kriminellen eine größere Varianz in ihrem Aussehen. Würden aber kriminelle und nichtkriminelle Gesichter zu einem durchschnittlichen Gesicht gemorpht, gebe es kaum einen sichtbaren Unterschied.

Um streng wissenschaftlichen Ansprüchen genügen zu können, müssten die Untersuchungen allerdings noch mit anderen Ethnien, Altersgruppen und Geschlechtern durchgeführt werden. Schon jetzt stellt sich allerdings die Frage, wie die Gesellschaft künftig mit diesen und anderen Fähigkeiten von Künstlicher Intelligenz umgeht. Soll es wie in „Minority Report“ möglich werden, Kriminelle schon zu erkennen, bevor sie Verbrechen begehen? Sollen Maschinen bei der Einreise in ein anderes Land das Gesicht entsprechend checken? Gruselige Vorstellung, aber sicher nicht unmöglich.

Bitte beachte unsere Community-Richtlinien

Wir freuen uns über kontroverse Diskussionen, die gerne auch mal hitzig geführt werden dürfen. Beleidigende, grob anstößige, rassistische und strafrechtlich relevante Äußerungen und Beiträge tolerieren wir nicht. Bitte achte darauf, dass du keine Texte veröffentlichst, für die du keine ausdrückliche Erlaubnis des Urhebers hast. Ebenfalls nicht erlaubt ist der Missbrauch der Webangebote unter t3n.de als Werbeplattform. Die Nennung von Produktnamen, Herstellern, Dienstleistern und Websites ist nur dann zulässig, wenn damit nicht vorrangig der Zweck der Werbung verfolgt wird. Wir behalten uns vor, Beiträge, die diese Regeln verletzen, zu löschen und Accounts zeitweilig oder auf Dauer zu sperren.

Trotz all dieser notwendigen Regeln: Diskutiere kontrovers, sage anderen deine Meinung, trage mit weiterführenden Informationen zum Wissensaustausch bei, aber bleibe dabei fair und respektiere die Meinung anderer. Wir wünschen Dir viel Spaß mit den Webangeboten von t3n und freuen uns auf spannende Beiträge.

Dein t3n-Team

Unabhängig davon, was Wu und Zhang glauben, bedeuten die Daten nicht, dass man aus einem Gesicht erkennen kann, ob ein Bürger in der Vergangenheit gegen ein Gesetz verstoßen hat.

Bestenfalls lässt es Rückschlüsse zu, wie wahrscheinlich jemand verurteilt wird.

Was man jedenfalls erwarten sollte, ist, dass Menschen aus Gegenden, die reichlich Motiv und Gelegenheit, aber wenig Alternativen dazu, bieten, seinen Lebensunterhalt auf illegale Art und Weise zu bestreiten, auch öfter dessen schuldig befunden werden als andere, und weiters, dass Menschen aus der gleichen Gegend oft auch äusserliche Gemeinsamkeiten aufweisen.

Daten in eine KI schütten zu können befähigt einen noch lange nicht dazu Statistik zu betreiben. Die Erkenntnisse, die ein Elektronenhirn liefert, sind letztendlich nur so gut wie die Daten, auf denen sie beruhen, und dazu muss man auch wissen, wie sie zustandekommen.

Vielleicht deckt die KI auch nur die Vorurteile auf, die unbewusst in den Köpfen von Richtern und Polizisten dazu führen, dass Menschen mit einem bestimmten äußeren Eigenschaften eher verhaftet werden als andere und damit als „kriminell“ eingestuft werden. Dann würde das bedeuten, dass wir mit so einer KI unsere existierenden Vorurteile manifestieren und automatisieren können. Schöne neue Welt.