Apple Intelligence auf dem Prüfstand: So schlägt sich die KI in der iOS 18.1 Beta

Schon kurz nach der Präsentation der neuen KI-Funktionen für iPhone, iPad und Mac im Juni war klar, dass diese nicht direkt mit der Veröffentlichung von iOS 18 verfügbar sein werden. In den USA müssen die Nutzer:innen mindestens bis zum Herbst warten, wahrscheinlich wird es aber sogar eher Endes des Jahres. Und in Europa werden Apples neue KI-Funktionen sowieso nicht vor 2025 verfügbar sein.

Mit der Veröffentlichung der Developer-Beta von iOS und iPadOS 18.1 lässt Apple aber zumindest Entwickler:innen ein paar der Funktionen ausprobieren. Die Betonung liegt auf ein paar Funktionen, denn wirklich viel ist es noch nicht. Dennoch haben wir Apple Intelligence auf einem iPad Pro M4 mit der zweiten Beta von iOS 18.1 schon einmal ausprobiert und fassen diesen ersten Eindruck kurz zusammen.

Zuvor aber noch ein paar warnende Worte zur Developer-Beta von iOS 18.1. Während die erste Version in der EU komplett auf Apple Intelligence verzichten musste, reicht es bei der zweiten Beta aus, einen amerikanischen App-Store-Account zu besitzen und die Regionaleinstellung auf USA und US-Englisch umzustellen, um Apple Intelligence aktivieren zu können. Unabhängig davon, ob man sich in der EU aufhält oder nicht. Auf ein hartes Geoblocking scheint Apple aus irgendeinem Grund nun zu verzichten. Aber Achtung: Wer jetzt die neuen Funktionen selbst probieren möchte: Es handelt sich um Beta-Software, die niemals auf Alltagsgeräten installiert werden sollte, die in erster Linie für Entwickler:innen gedacht ist und die noch immer viele Fehler und Bugs beinhaltet.

Soviel zum Beipackzettel, jetzt zu Apple Intelligence!

Was jetzt schon geht

Wie bereits beschrieben, bietet die Beta von iOS und iPadOS 18.1 noch nicht alle Funktionen die Apple im Juni vorgestellt hat, vor allem alles mit Cloud-Anbindung fehlt noch. Aber zumindest ein paar der lokal auf den Geräten funktionierenden Funktionen sind bereits implementiert.

Die neue Siri

Na, wer findet die neue Siri? Man muss schon etwas genauer auf den Displayrand schauen, um Siri zu finden. In Real ist der Rand aber animiert und dadurch deutlich auffälliger (Bild: Screenshot t3n | Shareshot)

Die grafisch wohl herausstechendste Neuerung betrifft Siri. Statt wie bisher in einer Art Kugel dargestellt zu werden, zeigt nun ein wabernder bunter Rand am Display an, dass die Assistenz zuhört. Auch die neuen Stimmen und die Aussprache klingen anders und verbessert und ein paar der angekündigten neuen Siri-Funktionen sind in der Beta von iPadOS 18.1 auch bereits enthalten – bei weitem aber noch nicht alle. Und natürlich spricht die neue Siri bisher nur Englisch.

Dafür versteht sie einen besser. Auch wenn man sich mal verhaspelt oder mittendrin anfängt eine andere Frage zu stellen, Siri behält den Überblick und kommt damit klar. Das bringt schon Spaß und wirkt deutlich natürlicher als die alte Siri, ist aber noch weit entfernt vom Sprachmodus von ChatGPT oder Gemini Live.

Der deutlich verbesserte persönliche Assistent, wie Apple ihn bei der Keynote zur WWDC angekündigt hatte, ist Siri allerdings noch nicht. Hier fehlt der tiefe Einblick in die Apps und die Cloud-Anbindung an Apple Intelligence ist bisher nicht implementiert. Das beschneidet Siri deutlich in den Funktionen, wird aber später nachgereicht werden. So lange sieht Siri zumindest schon einmal besser und frischer aus und klingt schöner. Das ist doch auch schon was.

Schreibwerkzeuge mit KI

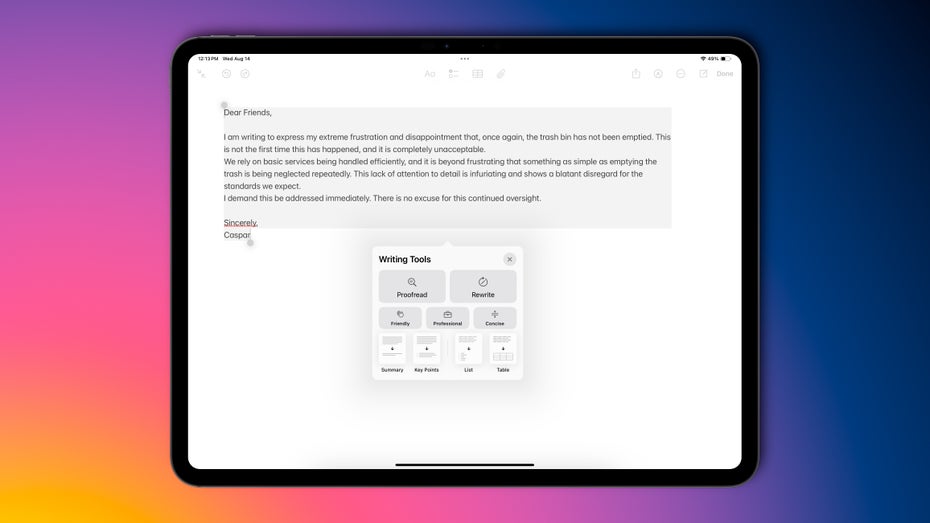

Texte können mit Apple Intelligence einfach umformuliert werden (Bild: Screenshot t3n | Shareshot)

Was wäre KI ohne Large-Language-Models (LLM) und auch Apple setzt auf diese bei den neuen Funktionen. So bieten die Betas bereits die Funktion Texte umformulieren zu lassen. Als Beispiel haben wir uns eine fiktive Nachricht an die Kolleg:innen ausgedacht, weil diese nie den Papierkorb leeren. Und weil der Text sehr frustriert und unfreundlich klingt, bitten wir Apple Intelligence ihn freundlicher zu formulieren. Dafür einfach den Text markieren, „Writing Tools“ anklicken und einen von drei Stilen auswählen. Nach wenigen Sekunden ist der Text deutlich kürzer, aber auch gleich freundlicher.

Zusammenfassung von Mails und Webseiten

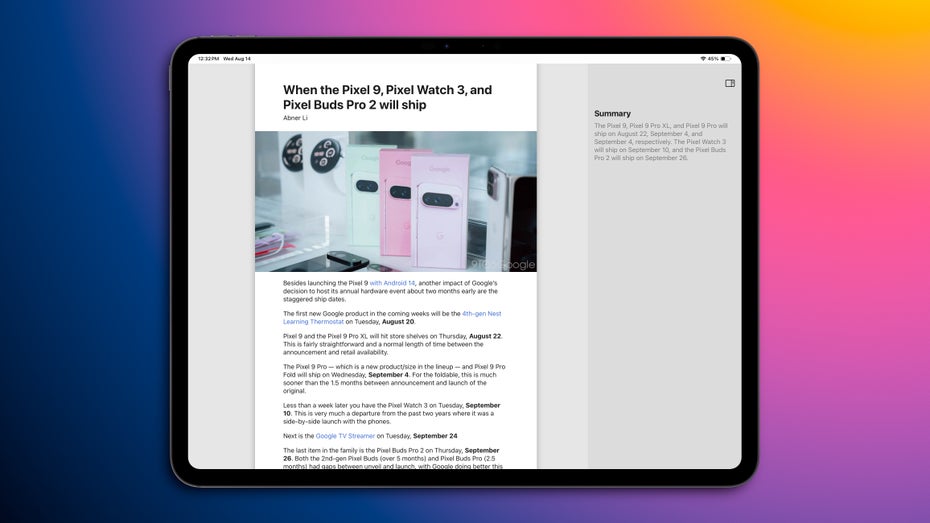

Die wichtigsten Infos des Artikels sind rechts zusammengefasst (Bild: Screenshot t3n | Shareshot)

Mit Sprachmodellen geht es auch in der nächsten Funktion weiter, denn Apples LLM kann nicht nur Texte umformulieren, sondern auch Nachrichten, Mails und Webseiten zusammenfassen. In der Mail-App steht statt eines Betreffs nun eine kurze Übersicht über den Inhalt. Öffnet man eine Mail kann man diese per Knopfdruck ebenfalls in wenigen Sätzen komprimieren. Und in Safari bietet der Reader-Modus ebenfalls einen Summary-Knopf. Gerade bei längeren Texten und Artikeln eine schnelle Möglichkeit den wichtigsten Inhalt auf einen Blick zu sehen.

Neuer KI-Fokus

Eine eher kleine, aber wenn sie funktioniert durchaus praktische neue Funktion ist der neue Fokus mit KI-Unterstützung. Bisher konnte man händisch festlegen welche Apps und Kontakte Benachrichtigungen durchstellen dürfen, sobald ein Fokus aktiviert ist. Mit Apple Intelligence lernt das System mit der Zeit welche Apps und Kontakte für einen wichtig sind und passt den Fokus entsprechend an. Ob und wie gut das tatsächlich funktioniert und ob wirklich nur wichtige Benachrichtigungen angezeigt werden konnten wir noch nicht wirklich testen, das muss ein längerer Zeitraum dann zeigen.

Foto-Erinnerung mit KI erstellen

Ebenfalls in unserem kurzen Test noch nicht ausprobieren konnten wir die Funktion mit der Unterstützung durch künstliche Intelligenz in der Fotos-App Erinnerungen mit einem Prompt zu erstellen. Dieser könnte zum Beispiel „Alle Hundefotos aus diesem Jahr“ lauten und Apple Intelligence sucht diese Bilder dann zusammen, erstellt daraus ein kleines Video, hinterlegt es mit Musik und spielt es dann ab. Aktuell spuckt die Fotos-App auf unserem iPad aber noch eine Fehlermeldung aus, vermutlich weil noch nicht alle Bilder im Hintergrund katalogisiert wurden. Ein oder zwei Nächte mit angeschlossenem Ladegerät sollten dabei Abhilfe schaffen.

„Alle Bilder mit Sonnenbrille“ spuckt leider auch normale Brillenfotos und eine Vision Pro aus (Bild: Screenshot t3n | Shareshot)

Was bereits funktioniert, ist die verbesserte Suche mit natürlicher Sprache. Heißt, man kann Dinge wie „Person XY mit Sonnenbrille“ eingeben und die Fotos-App spuckt alle passenden Bilder aus. Bei unserem Test waren auch einige Fotos mit normaler Brille und eine Vision Pro dabei, aber wir wollen bei einer Beta nicht zu penibel sein. Irgendwie ist die Vision Pro ja auch eine Brille.

Was noch fehlt

Das wars auch leider schon mit den ersten KI-Funktionen in den Betriebssystemen. Die Liste der Tools die noch nicht verfügbar sind ist fast länger als die der bereits integrierten. So fehlt zum Beispiel noch die komplette Anbindung an ChatGPT, die dann unter anderem länger Dokumente oder PDFs zusammenfasst. Auch Apples eigene Cloud-KI auf besonders abgesicherten Servern ist wie bereits gesagt noch nicht verfügbar. Vermutlich weil die Infrastruktur dafür noch gar nicht groß genug ist.

Ebenfalls nicht zu finden in den Betas sind bisher alle Bild-KI-Funktionen von Apple Intelligence. Es gibt also weder die Bild-KI-App Image Playground, noch die Genmojis. Und auch die Bildgenerierung in der Notizen-App und die Möglichkeit Dinge aus Fotos heraus zu retuschieren sucht man bisher vergebens.

Ausblick

Die aktuellen Betas zeigen noch einmal: Apple Intelligence wird nicht mit einem Schlag eingeführt, sondern tröpfchenweise in den nächsten Monaten auf den Geräten eintreffen. Auch wenn Apple im Juni diesen Jahres viele Funktionen vorgestellt hat, wird eher 2025 das KI-Jahr für den Konzern. Dann folgen im Sommer sicher neue KI-Funktionen und bis dahin werden die bereits bekannten integriert. Weitere Sprachen werden ebenfalls folgen und auch die EU wird früher oder später mitspielen dürfen.

Interessant wird auch zu sehen auf welche weiteren Geräteklassen Apple dann seine KI-Funktionen erweitert. Die Vision Pro besitzt ebenfalls einen M-Chip, wäre also kompatibel. Die Apple Watch könnte über das gekoppelte iPhone zum Beispiel die verbesserte Siri bekommen und neue HomePods mit M-Chip und 8 GB Arbeitsspeicher würden dann ebenfalls mit Apple Intelligence funktionieren. Aber das ist Zukunftsmusik, denn bisher ist nichts davon offiziell von Apple bestätigt.