Gelernt von OP-Videos: Chirurgie-Roboter näht erstmals autonom

In den Operationssälen der Welt sind immer häufiger krakenähnliche Roboter am Werk, die „Arme“ bestückt mit Bohrern, Scheren, Greifern und Spüldüsen. Die Geräte schneiden unter anderem Tumore aus dem Körper, reparieren Knochen und lasern Augen. „Weltweit kommen ungefähr vier Millionen Roboter jährlich in mehr als 300 Millionen Operationen zum Einsatz“, sagt Axel Krieger von der Johns Hopkins University in Baltimore, USA. Bisher werden die meisten dieser Roboter von den Chirurg:innen allerdings noch ferngesteuert. Kriegers Team treibt die Technologie gerade weiter in Richtung autonomes Operieren – und ist nun einen wichtigen Schritt vorangekommen, wie es kürzlich auf der „Conference on Robot Learning“ in München berichtete.

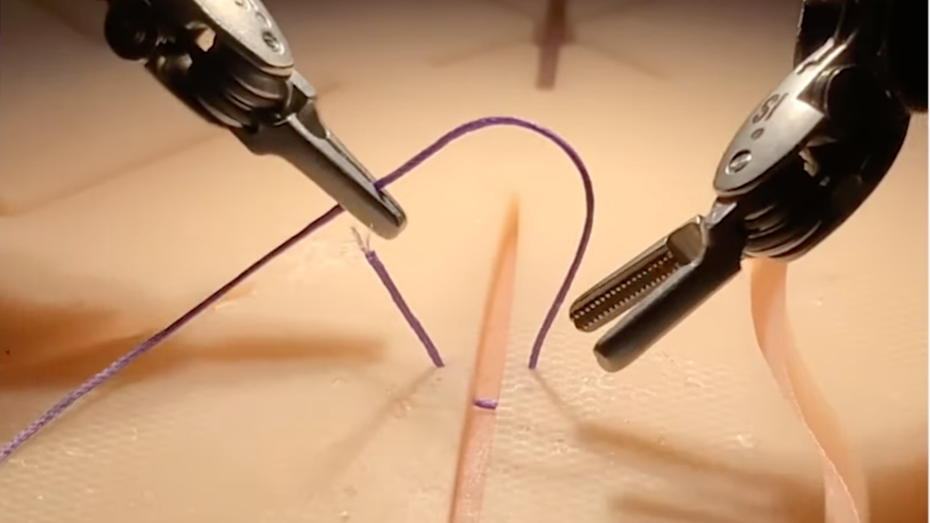

Die Forschenden haben einen Da-Vinci-Roboter des Herstellers Intuitive Surgical mit Videos trainiert und konnten ihm so Fähigkeiten einer Chirurgie-Fachperson verleihen – zumindest was das Nähen einer Wunde betrifft. Der Vorteil: Dem Roboter muss nicht mehr mit viel Aufwand jede Bewegung einzeln einprogrammiert werden. Erste Erfolge berichtete die Gruppe bereits im Juni in einem Paper auf dem Preprint-Server arXiv.

Roboter näht und knotet

„Es ist wirklich magisch. Wir füttern unser Modell lediglich mit Kameradaten, und es kann die für eine Operation erforderlichen Roboterbewegungen vorhersagen“, sagt Krieger. Damit lasse sich ein Roboter in nur wenigen Tagen auf eine bestimmte Aufgabe trainieren. Für das Modell hat das Team, dem auch Forscher:innen der Stanford University angehörten, das sogenannte Imitationslernen mit einem Transformer kombiniert. Das Training erfolgte laut Krieger in drei Disziplinen: „chirurgische Schritte wie Gewebe anheben, Nadeln aufheben und austauschen, und Knoten binden“. Für jeden Schritt waren zuvor zwischen 224 und 500 Videos als Trainingsmaterial in das Modell eingespeist worden. Die Aufnahmen stammten von ferngesteuerten Da Vinci Robotern, wie sie von zigtausenden Chirurg:innen weltweit genutzt werden.

Der Schlüssel liegt den Forschenden zufolge darin, das Modell so zu trainieren, dass es relative Bewegungen ausführt. Das Modell errechnet die jeweils wahrscheinlichste nachfolgende Bewegung – ähnliche wie große Sprachmodelle das nächste Wort eines Satzes vorhersagen können. Zudem lerne es eigenständig auch neue Dinge, berichtet Krieger. „Wenn der Roboter beispielsweise die Nadel fallen lässt, hebt er sie automatisch auf und macht weiter. Das habe ich ihm nicht beigebracht.“

Problemzone für Roboter: weiches Gewebe

Bis so ein Roboter Operationen aller Art autonom und zuverlässig durchführen kann, wird es wohl noch dauern. Zwar operieren manche Maschinen schon heute autonom. „Zum Beispiel bei einer Hüft-OP. Da kann ich vorher ein Bild vom Knochen nehmen und weiß dann genau: So sieht die Hüfte aus, so muss ich hier den Knochen ausschneiden, dieses Hüftgelenk kommt rein“, erklärt Krieger. Dann lasse sich der Roboter entsprechend programmieren. Auch in der Augenchirurgie mit dem Laser seien automatisierte Systeme schon gang und gäbe. „Man drückt nur auf einen Knopf und alles läuft von allein.“

Bei Eingriffen in weichem Gewebe hingegen ist das bisher nicht möglich. Das Gewebe kann während der OP anschwellen und Blut tritt aus. Das alles sei vorher nicht im Detail abzusehen, erklärt Krieger. Ein mit Videos trainierter Roboter hat hier vermutlich Vorteile. An Gewebeproben vom Schwein funktioniere die Technik schon gut. „Aber um das in der Zukunft an echten Patienten mit allen Variationen der Anatomie und der Krankheiten robust machen zu können, brauchen wir noch große Datensätze aus möglichst vielen Operationen“, sagt der Forscher.