Grenzkontrollen: Wieso KI-Lügendetektoren keine gute Idee sind

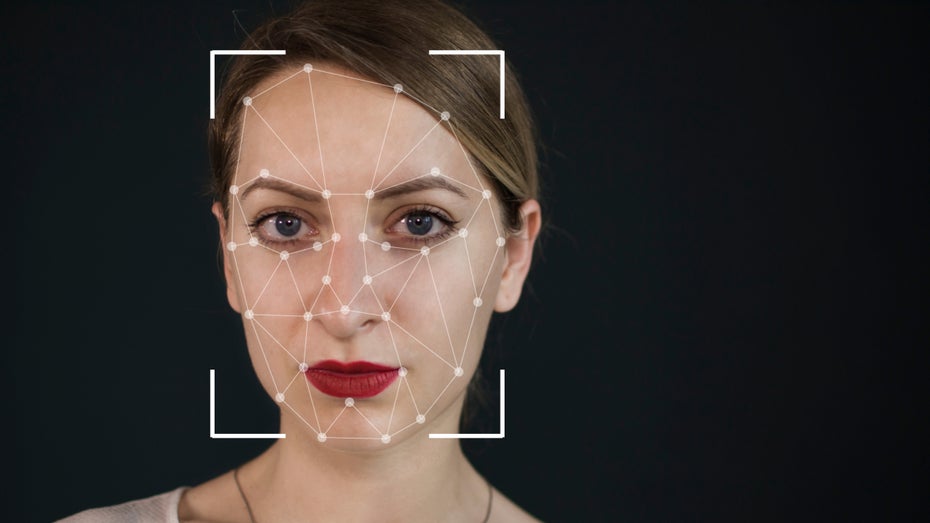

An einem EU-Grenzübergang: Ein junger Reisender wird von den Beamten gebeten, für weitere Fragen in einen separaten Raum mitzukommen. Dort wird er nicht von einem Menschen, sondern von einem virtuellen Grenzbeamten auf einem Bildschirm zum Verhör begrüßt. Der KI-Avatar stellt dem jungen Mann Fragen, während dessen Mimik und Sprache aufgenommen werden. Die angeschlossene Software analysiert in Echtzeit, ob der Mann die Wahrheit sagt oder lügt beziehungsweise ob er als Tourist unterwegs ist, wie er behauptet, oder ob er womöglich eine unerlaubte Migration plant.

Noch finden solche Szenen an den EU-Außengrenzen nicht statt. Doch die Technologie wurde unter dem Namen iBorderCtrl zwischen 2016 und 2019 bereits getestet und mit mehr als 4,5 Millionen Euro an Fördergeldern von der Europäischen Union unterstützt. Das Projekt war und ist umstritten. So hatte der Europaabgeordnete Patrick Breyer bereits 2019 eine Transparenzklage gegen das Projekt eingereicht, da er die Rechtmäßigkeit der Technologie anzweifelte. Jan Böhmermann hatte am 24. Mai in einer Ausgabe des ZDF Magazin Royale iBorderCtrl zum Thema „Smart Borders“ aufgegriffen – neben weiteren umstrittenen KI-Projekten zur Grenzüberwachung.

Die Forschung an iBorderCtrl mag inzwischen beendet sein, relevant bleibt sie trotzdem. Denn mit dem jüngsten Aufschwung im Bereich der künstlichen Intelligenz (KI) wächst auch das Interesse, die Technologie für die Lügendetektion einzusetzen. Das Problem: Es ist wissenschaftlich nicht bestätigt, dass eine KI in der Lage ist, zuverlässig zwischen Wahrheit und Unwahrheit zu unterscheiden.

Kennzeichen für Lügen: Fehlanzeige

„Dem Einsatz von künstlicher Intelligenz in der Lügendetektion liegt die Annahme zugrunde, dass es möglich ist, ein eindeutiges Indiz oder eine Kombination von Indizien zu identifizieren, die auf eine Täuschung hinweisen“, schreibt die Psychologin Kristina Suchotzki von der Universität Marburg, die über die psychologischen Grundlagen des Lügens forscht, in einem aktuellen Beitrag im Fachmagazin Trends in Cognitive Sciences. Tatsächlich gebe es solche Indizien aber trotz jahrzehntelanger Forschung nicht. Der Polygraf etwa, den man aus Filmen als Lügendetektor kennt, zeichnet zwar physiopsychologische Parameter wie den Herzschlag einer Person auf, daraus lässt sich aber nicht sicher ableiten, ob diese die Wahrheit sagt oder lügt.

Unterstützer:innen von Projekten wie iBorderCtrl hoffen, dass KI Indizien finden könnte, die der bisherigen Technik verborgen blieben. Aber: Der Einsatz von KI zur Lügendetektion bringe neben dem Fehlen eines theoretischen Fundaments zudem noch andere Probleme mit sich, so die Expertin Suchotzki und ihr Kollege Matthias Gamer. Erstens seien die KI-Algorithmen eine Blackbox. Wie sie zu ihren Ergebnissen kommt, ist von außen unter Umständen nicht nachvollziehbar und somit auch nicht überprüfbar. Und selbst wenn eine Einsicht technisch möglich wäre, weigern sich Privatunternehmen häufig, ihre Algorithmen transparent zu machen.

Der KI-Lügendetektion mangelt es an Qualitätsstandards

Zweitens ist künstliche Intelligenz vor Bias und unzulänglichen Trainingsdaten nicht gefeit. Die Auswahl der Variablen, die in das Modell eingespeist werden, seien „häufig problematisch oder theoretisch unplausibel, weil die Trainingsdaten zu klein sind, nicht repräsentativ sind und Verzerrungen aufweisen“, schreiben Suchotzki und Gamer. Auf dem Gebiet der Lügenerkennung ist es generell schwierig, an gute Datensätze zu kommen. Entweder müsste man Testpersonen dazu aufrufen, bewusst zu lügen, was möglicherweise deren Reaktion verfälscht. Oder man müsste Aufnahmen von nachweislichen Lügen, etwa aus Verhören, als Quellen nehmen, die dann aber womöglich einen Bias aufweisen.

Die Wissenschaftler:innen rufen Entscheidungsträger:innen dazu auf, bei künftiger Forschung zu dem Thema „sorgfältig zu prüfen, ob bei der Entwicklung des Algorithmus grundlegende Qualitätsstandards eingehalten wurden“. Außerdem müsse eine wissenschaftlich fundierte theoretische Basis für die Forschung geschaffen werden, sodass die Technik nicht missbraucht werden kann.