Diese Website zeigt, wie sich Verschwörungsmythen auf Youtube verbreiten

Der Begriff „Rabbit Hole“ geht zurück auf Alice im Wunderland, die in einen Kaninchenbau fällt und so in eine völlig andere Welt gerät. Ähnlich ergeht es manchen Menschen auf Youtube, denen in den Empfehlung immer neue Videos angezeigt werden zu Themen, von denen der Youtube-Algorithmus annimmt, dass sie sie interessieren. Das geschieht über die Autoplay-Funktion über die Empfehlungen auf der Startseite, in der Seitenleiste und am Ende von Videos.

Tatsächlich berichten viele Menschen, dass sie vor allem über Youtube an neurechtes Gedankengut oder auch Verschwörungsmythen wie den Glauben an die flache Erde geraten sind. Weil Youtube daran interessiert ist, die Zuschauer möglichst lange auf der Plattform zu halten, zeigt es immer neue und immer radikalere Videos. Zugleich bekommenden die Produzenten der Videos den Anreiz, ihre Videos immer drastischer, polarisierender und gefährlicher zu gestalten.

Youtube sieht für jeden anders aus

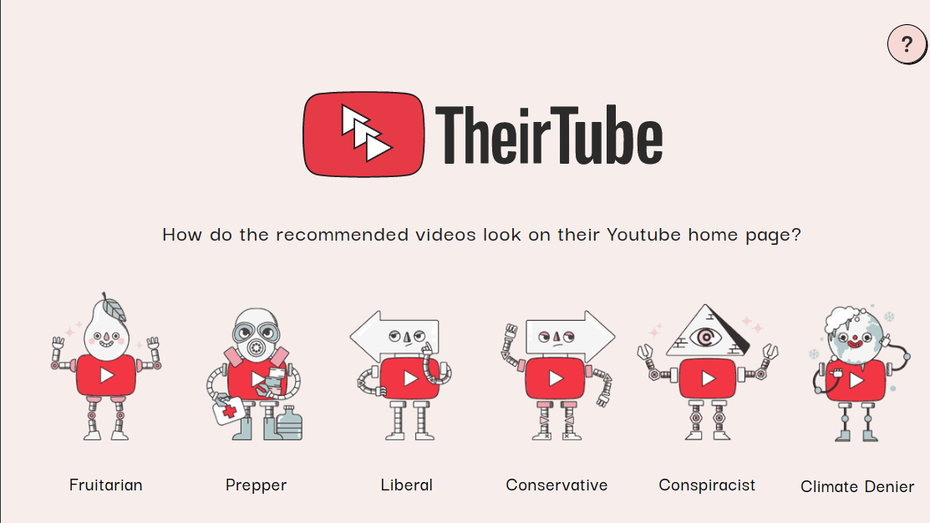

Das heißt auch: Youtube sieht für verschiedene Menschen vollkommen anders aus. Um dies sichtbar zu machen, haben die Designer Tomo Kihara und Polina Aexeenko mit Unterstützung der Mozilla-Foundation „Theirtube“ ins Leben gerufen. Diese Website zeigt, wie die Startseite von Youtube für verschiedene Gruppen wie etwa Frutarier, Prepper, Linksliberale, Konservative, Verschwörungsideologen und Erderwärmungsleugner aussieht.

Zunächst führt ein Besuch auf Theirtube zum altbekannten Gefühl belustigten Unglaubens mit dem Gedanken: „OMG, gibt es wirklich Leute, die sich das angucken, und was ist mit denen los?“ Allerdings verfliegt der Gedanke schnell wieder beim Klicken durch die verschiedenen Youtube-Varianten und es stellt sich die etwas beklemmende, aber durchaus heilsame Erfahrung ein, vielleicht selber auch nur im eigenen Rabbit Hole unterwegs zu sein.

Auch dieser Beitrage könnten dich interessieren:

- Gut vernetzt, aber einsam? – Freundschaften im digitalen Zeitalter

- Nach Garmin-Hack: Wer braucht überhaupt Fitness-Tracking?

- Jugendliche zocken während der Pandemie mehr als vorher – ja, und?

Schön jetzt auch die neusten Verlekmdungsbegriffe der CIA auf eurer seite zu finden.

Gruppen radikalisieren sich nicht selbst (etwa weil sie ahnungslos seien). Sie ->werden radikalisiertdie sich für „moralischer“ hält, während sie ausblendet, wie sie selbst Gruppen diskriminiert, die sie für „amoralischer“ hält. Emotionale Involviertheit hemmt die kognitive Leistungsfähigkeit, zum Beispiel die Fähigkeit zur Perspektivübernahme. Moralische Überzeugtheit geht einher mit starker emotionaler Involviertheit. Radikalisierung infolge Diskriminierung => gilt für alle Gruppen, nicht nur für „Opfergruppen“, sondern auch für als Mitglieder von „Tätergruppen“ diffamierte und marginalisierte Menschen.

so ein Blödsinn, da wird man in eine Kategorie gesteckt in die man nicht gehört, weil man selbst nur Musikvideos schaut.

Auch Facebook, Google, Instagram & Co. sehen für JEDEN anders aus. Ich sehe das Problem nicht. Natürlich zeigen die Algorithmen den Website-Besuchern weitere Inhalte, die auf dem zuvor Betrachteten beruhen und die am ehesten dazu dienen, die Leute am Ball zu halten. Bei mir würden andere zum Beispiel allerhand Psytrance-Sets sehen, neben Brainwave-Musik (für die Beschallung bei der Arbeit) und Videos mit Simon’s Cat, Bastelvideos usw. – einfach, weil meine Kinder und meine Frau ab und zu auch Zugriff auf YouTube haben. ;-) Man sollte die Filterbubble nur im Hinterkopf behalten und den Kopf beim „Glotzen“ und Surfen nicht abschalten. Und im Zweifel schaut man sich unterschiedliche Quellen zu einem Thema an, zum Beispiel Bücher. :-)

Beste Grüße

Patrick