In den neuen Versionen der Betriebssystem will Apple einen automatischen Scan-Mechanismus in die Fotos-App einbauen. (Bild: Apple)

Kurz nach der Bestätigung Apples, in Zukunft iPhones auf Bilder von Kindesmissbrauch zu scannen, laufen Kryptoexperten und Menschenrechtsorganisationen Sturm. Der Konzern bemüht sich derweil zu versichern, dass die Privatsphäre gewahrt bleibe. Doch davon abgesehen gibt es weitere Kritikpunkte an dem Plan, der mit Updates von iOS 15, iPadOS 15, watchOS 8 und macOS Monterey verwirklicht werden soll. Apple kündigte an, die Änderungen später in diesem Jahr einzuführen.

Apple gleicht iPhone-Bilder mit Missbrauchsfotos ab

Die Ingenieure beschreiben in einem Dokument die technische Realisierung der unfreiwilligen Foto-Scans. Demnach führt das System einen geräteinternen Abgleich mit einer Datenbank von Missbrauchsbildern (CSAM – Child Sexual Abuse Material) durch. Neben Darstellungen in realen oder simulierten sexuellen Handlungen fällt darunter auch die Darstellung der Geschlechtsteile eines Kindes „zu primär sexuellen Zwecken, egal mit welchen Mitteln.“ Die Datenbank stellen das National Center for Missing and Exploited Children (NCMEC) und andere Schutzorganisationen bereit. Apple wandelt sie in einen Satz von Hashes um, der „sicher auf den Geräten der Nutzer gespeichert wird“.

„Extrem hohes Maß an Genauigkeit“

Apple schreibt, das Erkennungssystem nutze einen Schwellenwert, der „ein extrem hohes Maß an Genauigkeit bietet und eine Wahrscheinlichkeit von weniger als eins zu einer Billion pro Jahr sicherstellt, dass ein bestimmtes Konto fälschlicherweise gekennzeichnet wird.“ Findet das System vermeintlich anstößige Bilder, werden deren Nutzerdaten entschlüsselt und der Account gesperrt. Das Unternehmen prüft die Meldungen manuell, bevor es sie an das NCMEC und Strafverfolgungsbehörden weiterleitet. Benutzer könnten einen Antrag auf Wiederherstellung stellen, wenn sie glauben, ihr Konto sei fälschlicherweise markiert worden, schreibt der iPhone-Hersteller.

Nachrichten-App wird ebenfalls gescannt

Neue „Werkzeuge“ will Apple auch in der Kurznachrichten-App „Messages“ hinzufügen. Diese ermöglichen, Eltern und Kinder vor sexuell eindeutigen Fotos zu warnen. Dabei verwende die App geräteinternes maschinelles Lernen, um Bildanhänge zu analysieren und explizite Fotos zu erkennen. Die Software stellt entsprechende Funde daraufhin unscharf dar, warnt das Kind vor dem Inhalt und stellt ihm „hilfreiche Ressourcen“ zur Verfügung. Das System benachrichtigt die Eltern, wenn Kinder ein gekennzeichnetes Bild ansehen. Ähnliche Schutzmaßnahmen plant Apple für das Versenden: Das Kind wird gewarnt, bevor es ein entsprechendes Bild sendet, und die Eltern können eine Benachrichtigung darüber erhalten.

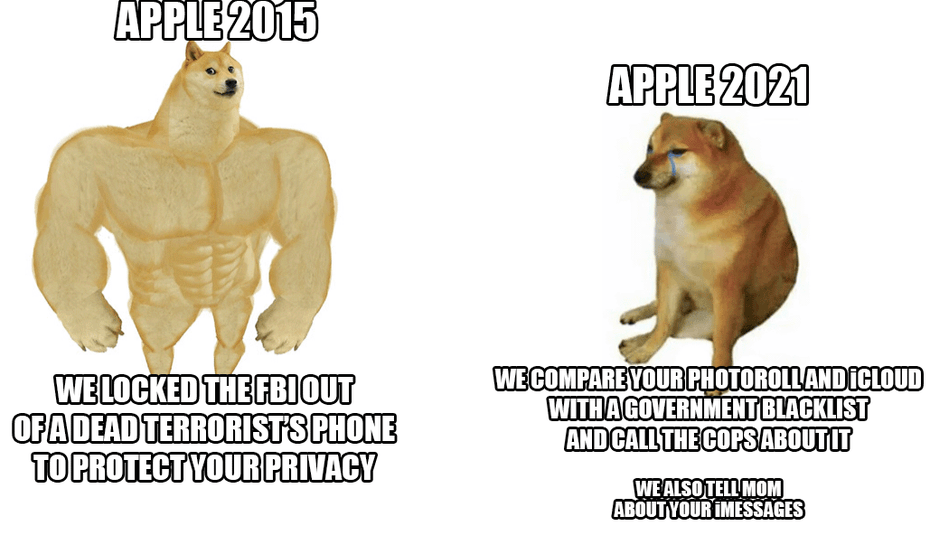

Auf Twitter kursieren die ersten Memes zu Apples Foto-Scan-Plänen. (Bild: Twitter)

Datenschützer: „Es ist eine Hintertür“

Clientseitiges Scannen am „Ende“ der Kommunikation unterbreche die Sicherheit der Übertragung und das Informieren einer dritten Partei – in diesem Fall der Eltern – untergrabe die Privatsphäre, geben Organisationen zu bedenken. Das Center of Democracy & Technology schreibt: „Der Mechanismus, der es Apple ermöglichen wird, Bilder in Messages zu scannen, ist keine Alternative zu einer Hintertür – es ist eine Hintertür.“ Weltweit warnen Bürgerrechtsinitiativen, dass das clientseitige Scannen von Regierungen und Unternehmen zur Überwachung privater Kommunikation eingesetzt werden könnte. Mit einem Brief wandte sich eine Gruppe von Experten an die Europäische Union, als dort diesbezügliche Pläne zur Eindämmung von Kinderpornografie zur Diskussion standen. Darin schrieben sie: „Die Ende-zu-Ende-Verschlüsselung zu brechen, um anstößige Online-Inhalte einzudämmen, ist so, als würde man versuchen, ein Problem zu lösen, indem man 1.000 weitere schafft. Unsichere Kommunikation macht die Nutzer anfälliger für die Straftaten, die wir gemeinsam zu verhindern versuchen.“

Kritiker befürchten nun eine Welle von Scan-Initiativen

Ross Anderson, Professor für Sicherheitstechnik an der Universität Cambridge, kommentierte Apples Pläne so: „Es ist eine absolut schreckliche Idee, weil sie zu einer verteilten Massenüberwachung unserer Telefone und Laptops führen wird.“ Edward Snowden teilte den Kommentar auf Twitter. Dahinter steht die Angst, dass das System in Zukunft auf andere Bilder und Texte angepasst wird: erst Kindesmissbrauch, dann Terrorismus, dann regierungskritische Proteste. Ein Kollege von Anderson, Matthew Green von der John Hopkins University, schreibt dazu: „Das wird den Damm brechen – die Regierungen werden dies von allen verlangen.“ Alan Woodward, Professor für Computersicherheit an der University of Surrey, sagte der Financial Times: „Apples dezentralisierter Ansatz ist so ziemlich der beste Ansatz, den man wählen kann, wenn man diesen Weg einschlägt.“

Auch wenn der Scan zunächst nur für US-Accounts gilt, weckt Apples Vorgehen Befürchtungen. Neben dem Bruch der Privatsphäre für Kinder und alle anderen Apple-Nutzer stellen sich viele ungeklärte Fragen. Welche Kriterien setzt das von Ronald Reagan gegründete NCMEC an? Wird demnächst mein Account blockiert, weil ich ein Foto meiner nackten Tochter auf dem iPhone habe? Noch mehr stört mich die Perspektive dieser Maßnahme: Was kommt nach den gehashten Missbrauchsfotos? Dürfen wir dank ultrachristlicher Dominanz in der amerikanischen Gesellschaft bald gar keine Nacktfotos mehr verschicken? Auch ich befürchte die Öffnung für weitere ungewollte Aktivitäten: Das Thema Terrorismus hat meiner Meinung nach schon genug Freiheitsrechte gekostet, sind in Zukunft unsere Fotoalben dran?

Das andere Reiz-Thema betrifft Cyber-Missbrauch. Ban-as-a-Service-Scammer könnten nach Instagram nun auch die Apple-Plattform als gewinnträchtige Spielwiese entdecken. Können Böswillige in Zukunft meinen Account lahmlegen, indem sie mir ein Missbrauchsbild schicken? Für mich bietet die Maßnahme mehr Gefahren als Nutzen. Nach den jüngsten Berichten bekommt man eine Ahnung davon, dass Sexualstraftäter andere Plattformen bevorzugen. Die Verbliebenen werden just in diesem Augenblick Apple den Rücken kehren und die neuen „Sicherheitsmaßnahmen“ in Leere laufen lassen. Stattdessen kommt auf Apple-Nutzer viel Ungemach zu, wenn automatische Systeme dann doch mal Fehler machen und zudem weitere Hintertüren drohen.

Raimund Schesswendter

In sechs Monaten gibt es in der EU eine Scanpflicht.