Google Assistant: Der Sprachassistent reagiert bald bis zu zehnmal schneller und funktioniert offline

Google hat eigenen Aussagen zufolge einen Meilenstein bei der Spracherkennung erreicht, dank dem der Google Assistant lokal auf dem Smartphone ausgeführt werden kann. Während für die Nutzung des Assistants bislang eine Software-Basis von um die 100 Gigabyte notwendig war, habe man die Datengröße des erforderlichen Systems mithilfe von Fortschritten bei rekurrenten neuronalen Netzen auf 500 Megabyte schrumpfen können, erklärte Google-Chef Sundar Pichai.

Der neue Google Assistant kommt wohl mit dem Pixel 4

Durch die massive Reduzierung könne die KI hinter dem Google Assistant künftig direkt auf dem Smartphone ausgeführt werden. Durch die lokale KI sei es möglich, dass der Assistent nahezu ohne Verzögerung auf eure Anfragen und Sprachbefehle reagiert, selbst wenn gerade keine Internetverbindung bereitsteht respektive sich das Telefon wie während der Demo auf der I/O im Flugzeugmodus befindet.

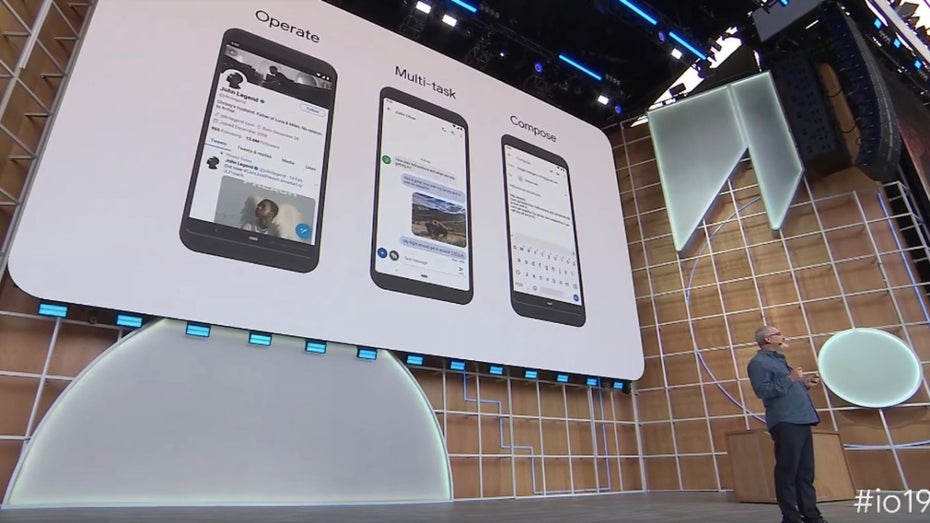

Laut Google kann der Assistant künftig Anfragen in Echtzeit verstehen sowie verarbeiten und die Antworten bis zu zehnmal schneller abliefern. Darüber hinaus sei es möglich, dass mithilfe des Assistants verschiedene Apps gleichzeitig aufgerufen und schneller denn je Kalendereinträge erstellt werden können. Ebenso soll man nach Fotos suchen, und sie per Sprachbefehl direkt mit Freunden und Kontakten teilen können. Auch das Diktieren und Versenden einer E-Mail sei, ohne einen Finger zu rühren, durchführbar.

Während der Demonstration auf der I/O-Bühne musste zwischen den Befehlen nicht jedes Mal das Hotword „Okay Google“ gesagt werden. Denn mit der Funktion „Durchgängige Unterhaltung“ könne man gleich mehrere Anfragen hintereinander stellen.

Der „Next Gen“-Assistant soll im Herbst mit der vierten Generation von Googles Pixel-Smartphones eingeführt werden, erklärte Google-Assistant-Chef Scott Huffman.

Google Assistant will persönlicher werden

Google will die nächste Generation des Google Assistant noch nützlicher machen. Dafür muss der Nutzer dem Assistant mehr von sich preisgeben – etwa wo die Mutter wohnt, wie die Schwester heißt und wann sie Geburtstag hat. Mit diesem Wissen bewaffnet, können Nutzer künftig Fragen und Erinnerungen stellen wie „Ok Google, wie ist das Wetter bei Mama an diesem Wochenende?“ oder „Erinnere mich daran, eine Woche vor dem Geburtstag meiner Schwester Blumen zu bestellen“. Diese persönlichen Informationen sollen auf einem neuen „Ich“-Tab in den Einstellungen des Assistant Platz finden. Sie sollen jederzeit bearbeitet oder gelöscht werden können.

Google Assistant: Duplex fürs Web und Driving Mode

Abgesehen vom neuen ultraschnellen Google Assistant hat Google auf der I/O weitere neue Funktionen für den Sprachassistenten angekündigt. Mit Google Duplex fürs Web sollen sich beispielsweise Mietwagenbuchungen automatisiert vom Assistenten ausführen lassen. Dabei muss der Nutzer alle dafür erforderlichen Daten bereitstellen. Zur Buchung eines Mietautos müsst ihr dann nur noch sagen „Buch mir einen Mietwagen bei National für meinen nächsten Trip“ – den Rest könnt ihr dem Assistenten überlassen. Dieser navigiert beispielsweise durch die Website und gibt alle Informationen basierend auf euren Präferenzen ein.

Die Webversion von Duplex soll noch in diesem Jahr auf Englisch in den USA und Großbritannien für das Buchen von Mietwagen und Kinotickets auf Android-Smartphones an den Start gehen, so Google.

Mit dem Fahrmodus des Google Assistant sollen Nutzer ihr Smartphone im Auto optimal mit der Sprache steuern zu können. Dafür habe Google ein Dashboard entwickelt, das es ermögliche, alle relevanten Funktionen wie die Navigation, das Versenden von Nachrichten und Anrufe ausschließlich mit der Stimme zu bedienen. Der neue Modus soll schon im Sommer 2019 für alle Smartphones mit dem Google Assistant freigegeben werden.