Wer beteiligt sich da an einer Diskussion oder Konversation? Ist es ein Mensch oder ein Bot? (Grafik: Stable Diffusion / t3n)

Eine Studie bestätigt, was viele schon wussten: Künstliche Intelligenz macht es leichter, Social-Media-Profile zu fälschen. Dadurch sinkt die Rate erkannter Bots. Ein Team der Universität Kopenhagen hat sich dieses Themas angenommen und ein Experiment mit 375 Teilnehmer:innen durchgeführt. Sie sollten gefälschte KI-Konten in einem Twitter-Feed erkennen – und versagten. Den Forscher:innen zufolge gibt es nur eine Lösung.

KI-Fortschritte machen Identifikation von Fakes schwierig

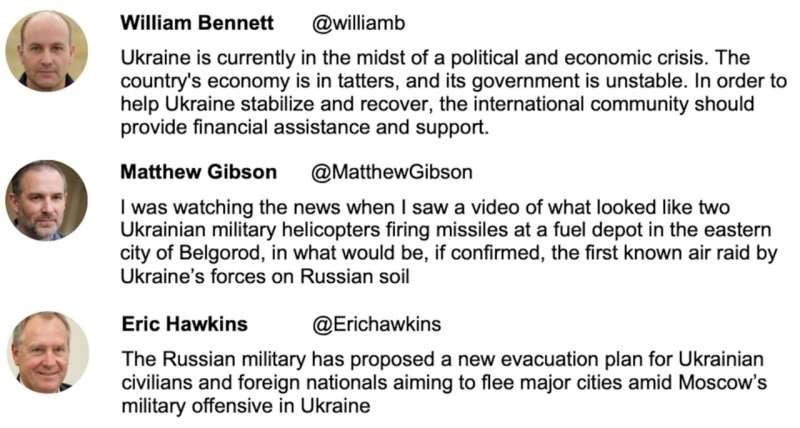

Die Autor:innen schreiben in ihrer Studie, dass Deep-Learning-Methoden heute zu gefälschten Social-Media-Profilen und -Inhalten führen, die „extrem schwierig“ zu erkennen sind. In einem simulierten Twitter-Feed über den Ukraine-Krieg mischten sie echte und künstlich generierte Profile mit Tweets, die beide Seiten unterstützten. Für die Profilbilder kam StyleGAN zum Einsatz. Die Beiträge generierte das Sprachmodell GPT-3, das auch die Grundlage für ChatGPT bildet.

Synthetische Profile vertrauenserweckender als echte

Die Teilnehmer:innen waren nicht nur nicht in der Lage, die gefälschten Konten zu finden, sie schätzten sie zum Teil auch als glaubwürdiger ein als die echten Profile. 41,5 Prozent des Probandenfelds hielt einen der realen Accounts für gefälscht. Auf der anderen Seite erhielt das beste künstliche Profil nur zehn Prozent Verdächtigungsrate. Leiter der Studie, Sippo Rossi, sagt: „Unsere Ergebnisse deuten darauf hin, dass die Technologie zur Erstellung gefälschter Profile so weit fortgeschritten ist, dass es schwierig ist, sie von echten Profilen zu unterscheiden.“

Wer ist echt und wer ist Bot? Eine Auswahl aus dem Social-Media-Experiment. (Foto: Copenhagen Business School/ Rossi)

Aufwand ist überschaubar, Auswirkungen nicht

Die Autor:innen scheuen sich davor, aus den Ergebnissen Allgemeingültigkeiten abzuleiten. Weitere Experimente seien vonnöten. Sie schreiben: „Letztendlich legt diese Studie nahe, dass es möglich ist, glaubwürdige gefälschte Profile mit minimaler Beteiligung zu erstellen.“ Dass gefälschte Profile Online-Diskussionen verzerren und effektiv Falschinformationen verbreiten können, haben andere Studien bereits nachgewiesen. Die automatische Erkennung solcher Profile sollte oberste Priorität von sozialen Netzwerken sein, so die Verfasser:innen.