5 Gründe, warum Verschwörungstheorien auf Social Media boomen

Facebook optimiert auf Interaktion, Youtube auf die Zeit, die Menschen mit den Videos verbringen. Und die Nutzer verlieren sich zwischen wütenden Kommentaren, Vorschlagalgorithmen und Datenleeren. (Grafik: t3n)

Wenn man mit Menschen spricht, die an Verschwörungserzählungen glauben, hat man oft das Gefühl, dass sie in einer anderen Welt leben. Viele der Menschen, die man im Corona-Sommer auf den Berliner Anti-Masken-Protesten getroffen hat, waren fest davon überzeugt, dass „heute ein Friedensvertrag zustande kommt.“ Ein Friedensvertrag zwischen dem „Deutschen Kaiserreich“, den USA und Russland. „Das wird episch“, erklärte mir James, ein Eventbauer aus Köln mit der Aufschrift „Qlobal Change“ auf dem Hoody vor dem Brandenburger Tor.

Warum glaubt jemand, dass es das Kaiserreich noch gibt?

„Qlobal Change“ ist mit über 120.000 Abonnenten einer der reichweitenstärksten Telegram-Kanäle der QAnon-Bewegung – einer Verschwörungsideologie, die vor allem seit dem Beginn der Coronakrise starken Zulauf hat. Im Groben handelt QAnon davon, dass Donald Trump im Verborgenen gegen eine vermeintliche geheime Organisation kämpfe. Diese vermeintliche geheime Organisation, so die QAnon-Erzählung, würde Tausende gekidnappte Kinder unter der Erde gefangen halten, um aus ihren Zirbeldrüsen das Stoffwechselprodukt Adrenochrom zu gewinnen – eine vermeintliche Wunderdroge. (Adrenochrom gibt es wirklich, es entsteht aber bei der Oxidation von Adrenalin und kann leicht synthetisiert werden. Eine Droge ist Adrenochrom nicht.)

Der Name QAnon leitet sich dabei von einem Account ab, der auf Foren wie 4Chan unter dem Pseudonym „Q“ kryptische Posts teilt. Nur Donald Trump und die QAnon-Anhänger – so die Erzählung – kennen daher die vermeintliche „Wahrheit“.

Gekidnappte Kinder, unterirdische Verließe, eine geheime Weltverschwörung: Viele der QAnon-Erzählungen klingen bizarr. Für Deutschland gibt es keine Zahlen (außer den Mitgliederzahlen der deutschsprachigen Chats.) In den USA glauben laut einer aktuellen Umfrage aber 33 Prozent der Wähler der Republikaner, dass die Verschwörungserzählung größtenteils stimme. Weitere 23 Prozent der Republikaner glauben, dass die Erzählung zumindest Teilweise wahr ist.

Schon seit Jahrhunderten denken sich Menschen Verschwörungserzählungen aus. Auch QAnon beruht zum Teil auf der antisemitischen Ritualmordlegende aus dem Mittelalter. Trotzdem ist gerade die Erzählung QAnon ohne die Dynamiken des Internets schwer vorstellbar.

Mit diesen fünf Effekte des sozialen Internets breitet QAnon sich aus.

- Der Online-Gossip-Faktor: Falsche Nachrichten verbreiten sich schneller als wahre Nachrichten

Schon seit 2018 gibt es Studien, die belegen, dass falsche Informationen – Fake News – sich auf sozialen Netzwerken schneller verbreiten als korrekt recherchierte Nachrichten. Laut dem MIT Professor Sinan Aral, dem Autor einer Studie zum Thema, haben falsche Geschichten eine 70 prozentig höhere Wahrscheinlichkeit, auf Twitter retweetet zu werden – sie verbreiten sich damit bis zu sechsmal schneller als korrekte Nachrichten. Als Grund dafür sehen Experten, dass falsche Nachrichten – ähnlich wie Gerüchte – oft überraschender und spannender sind als die Realität. In einer aktuellen Studie hat der Münchner Political-Data-Science-Forscher Simon Hegelich neben Twitter auch Facebook, Reddit und 4Chan untersucht und festgestellt: Corona-Verschwörungserzählungen waren dort im Schnitt viraler als neutrale Nachrichten.

- Facebooks Wut-Algorithmen: Was ärgert, klickt gut

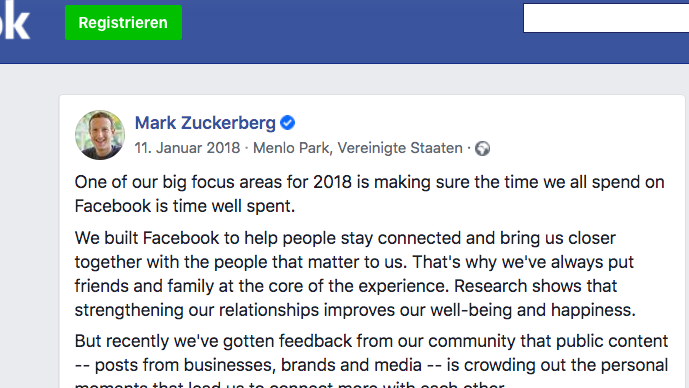

Anfang 2018 gab Mark Zuckerberg bekannt, dass Facebook den Newsfeed Algorithmus ändert – der Algorithmus, der bestimmt, welche Posts 2,7 Milliarden monatliche Nutzer sehen, wenn sie Facebook öffnen. Facebook zeigt seinen Nutzern seitdem weniger Nachrichten an – und mehr Posts, die Interaktion und Reaktion hervorrufen: Also Posts, unter die Nutzer Likes setzten oder wütende Smileys oder Kommentare. „Time well spent“ – gut genutzte Zeit, nennt Mark Zuckerberg das.

1 von 7

Ein Bericht des Social-Media-Recherche-Unternehmens Newswhip zeigt aber: Facebook hat damit vor allem auf die Reaktion „Wut“ optimiert. Im englischsprachigen Facebook erreichen Posts, die Wut oder Angst auslösen und über die Nutzer streiten, die bei Weitem die meisten Menschen. Die meistgeteilten Artikel im Frühjahr 2019 waren: „Verdächtiger Menschenhändler und Kinderräuber ist in unserer Gegend“ und „Mörder kriegen in New York keine Giftspritze, dafür aber ungeborene Kinder“.

Nach Facebooks Optimierung auf Engagement und Kommentare, erreichen Posts, die starke Gefühle auslösen, Tausende von Menschen. Schon der erste Satz in dem Kommentar im Screenshot ist eine irreführende Lüge: Auch in New York ist eine Abtreibung nach der 24. Schwangerschaftswoche nur möglich, wenn eine lizenzierte Ärztin feststellt, dass der Fötus nicht lebensfähig ist oder die Mutter in Gefahr schwebt. Trotzdem wurde der Post auf Facebook drei Millionen mal geteilt. (Screenshot: t3n)

Viele der Posts, die jetzt auf Facebook viral gehen, sind dabei teilweise falsch oder grob missverständlich: Über 800.000 Menschen dachten, der „verdächtige Kinderräuber“ sei tatsächlich in ihrer („unserer“) Gegend – dabei handelte der Artikel von der Kleinstadt Waco in Texas. Während des Zeitraums der Studie war „Foxnews“ die Facebook-Seite mit dem meisten Engagement – und die Seite mit den bei Weitem meisten wütenden Smileys. (Mehr dazu in diesem Artikel.)

Ein „Kinderräuber in unserer Gegend?“ Verständlicherweise erschreckte dieser Post viele Facebook-Nutzer. Aus Angst um Freunde und Verwandte teilten Hunderttausende den Artikel – die meisten dürften dabei nicht verstanden haben, dass es nicht tatsächlich um „ihre Gegend“ ging – sondern um die Kleinstadt Waco in Texas. (Screenshot: t3n)

Natürlich glauben nicht alle wütenden Facebook-Nutzer auch gleich an Verschwörungserzählungen. Aber viele Verschwörungserzählungen leben von der Empörung, die sie verursachen – und finden damit auf Facebook den optimalen Nährboden.

- Youtubes „Rabbit Hole“

Ähnlich wie Facebook hat Youtube seit der Gründung 2005 einige Algorithmus-Updates hinter sich. Die wohl wichtigsten dabei: Im Jahr 2012 wechselte Youtube von der Optimierung auf Klicks („Views“) hin zur Optimierung auf „watchtime“ – die Zeit, die Nutzer insgesamt damit verbringen, Videos anzuschauen. Im Jahr 2015 führte Youtube „Google Brain“ zur Optimierung der Vorschläge ein.

Vor „Google Brain“ hatten Youtubes Vorschlag-Algorithmen den Nutzern vor allem mehr vom Gleichen angeboten – ähnlich wie Amazon seinen Kunden vorschlägt: „Nutzer, die X kauften, kauften auch Y.“ Mithilfe von „Google Brain“ schaffte Youtube aber den Sprung von „mehr vom Gleichen“ hin zu Inhalten, die ähnlich, aber doch etwas anderes waren. Hätte einem der Youtube-Algorithmus beispielsweise nach einem vegetarischen Kochrezept sonst noch ein vegetarisches Kochrezept vorgeschlagen, ist Google Brain smart genug, um zu ahnen: Dieser Mensch interessiert sich bestimmt auch für ein veganes Rezept – oder für eine Doku über die Misere der industriellen Schweinezucht.

Die ständigen Iterationen des Vorschlagalgorithmus haben Youtubes Zahlen explodieren lassen: Laut dem Daten-Analyse-Unternehmen Sandvine machte Youtube allein schon 2019 35 Prozent des weltweiten Mobile Traffics aus.

Die Updates haben aber auch dafür gesorgt, dass Youtube-Nutzer leichter in einen Strudel immer extremerer Videos abrutschen können – das sogenannte „Rabbit Hole“ (in einer Anlehnung an das Buch ‚Alice im Wunderland‘). Wenn man aktuell auf Youtube Videos von Impfgegnern schaut, stehen die Chancen nicht schlecht, dass Youtube rechts am Rand extremere Inhalte empfiehlt – und man sich zwei Klicks später schon die ersten „Beweise“ einer Verschwörungserzählung anschaut. Natürlich speichert Youtube die Suchhistorie und richtet beim nächsten Besuch der Seite die Vorschläge danach aus. (Weshalb mir nach einer Youtube-Recherche zu Verschwörungserzählungen jetzt Videos vorgeschlagen werden wie „Wann wird Satan auf die Erde geworfen?“)

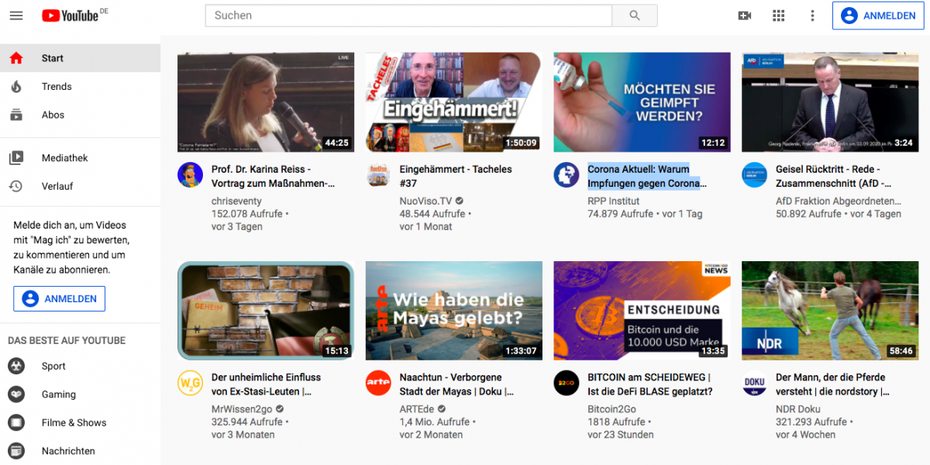

Für eine Recherche habe ich auf Youtube Videos zu Verschwörungserzählungen geschaut. Ein paar Tage später werden mir die Verschwörungserzählungen schon vorgeschlagen, ohne dass ich danach suche. Wenn ich jetzt auf Youtube.de gehe, erzählen die ersten vier Videos vom „Corona-Quatsch“, der „Lügenpresse“, und warnen davor, dass „Impfen Krebs verursache“. Das vierte Video ist von der AfD. (Screenshot: t3n)

- Die „Data Voids“ der Algorithmen

Wer den Begriff „Tesla“ bei Google, Facebook, Twitter und Youtube sucht, findet ungefähr, was man erwartet: Links zur Firmenwebsite, zu Fan-Gruppen, zu Tesla-Nachrichten, zu Videos von Model X. Einen Link, eine Gruppe oder eine Nachricht zu dem Begriff Tesla weit oben in den Suchergebnissen unterzubringen, ist nicht einfach: „Tesla“ wird oft gesucht, zu „Tesla“ findet Google 288 Millionen Ergebnisse, zu „Tesla“ gibt es ständig neue Nachrichten. Tesla ist gewissermaßen das Gegenteil einer „Data Void“ – einer Datenleere.

Der Begriff „Data Void“ geht zurück auf eine Studie der Microsoft-Forscher Michael Golebiewski und Danah Boyd und beschreibt einen Suchbegriff, zu dem es nur wenige oder alte (oder für Suchmaschinen unattraktive) Ergebnisse gibt. Wer so eine Datenleere entdeckt, kann die Nische bewusst oder unbewusst selbst füllen.

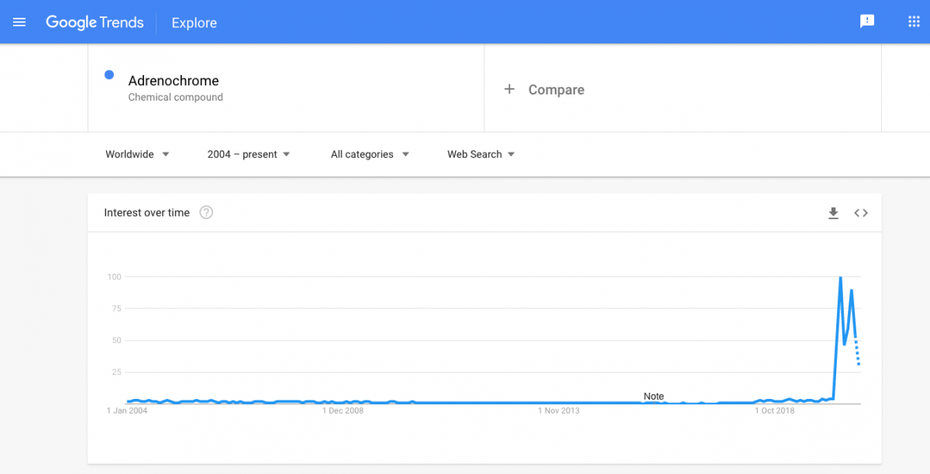

Adrenochrom ist ein Stoffwechselprodukt, das in den 50ern entdeckt wurde – und das über Jahrzehnte hinweg auf sehr wenig Interesse gestoßen ist. Zu dem Begriff wurde wenig veröffentlicht, nach dem englischen Begriff „Adrenochrome“ wurde wenig gesucht. In dieser Datenleere (Data Void) konnten Verschwörungserzählungen zu dem Begriff „Adrenochrome“ die oberen Plätze der Suchmaschinen-Rankings erobern. Im Frühling 2019 stiegen die Suchanfragen für den Begriff Adrenochrome sprunghaft an – und die Menschen fanden: Verschwörungserzählungen. (Screenshot von Google Trends: t3n)

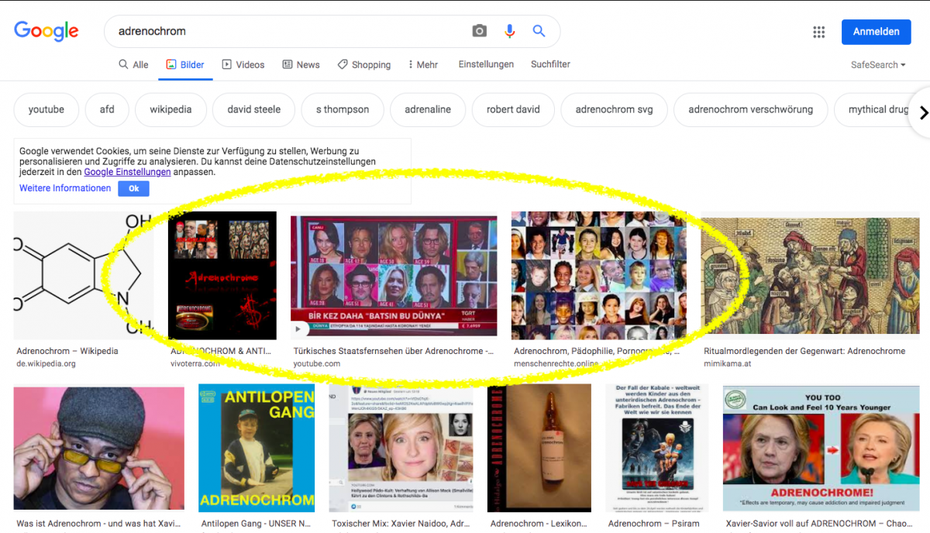

Mit dem Begriff „Adrenochrom“ nutzt die QAnon-Bewegung eine dieser Datenleeren. Seit der Entdeckung des Stoffwechselprodukts in den 50ern tauchte der Begriff nur kurz in Hunter S. Thompsons „Fear and Loathing in Las Vegas“ auf – und produziert deswegen kaum hochwertige oder aktuelle Suchergebnisse. (Auch Thompson hielt Adrenochrom fälschlicher Weise für eine Droge.) Die QAnon-Bewegung war deshalb in der Lage, einen kleinen Kosmos an Inhalten rund um den Begriff herum zu stricken. Auch jetzt, nach Monaten der Berichterstattung über QAnon, tauchen die Links einer angeblichen Andrenochromverschwörung prominent in Googles Bildersuche auf.

Noch jetzt können Links zur Verschwörungserzählung um den Begriff „Adrenochrom“ prominent in der Google Bildersuche auftauchen: Bei einem kurzen Test führen drei der ersten fünf Links direkt zu Adrenochrom-Verschwörungserzählungen. Erst der fünfte Treffe (v.l.) führt zu einem Fact-Checking-Artikel zum Thema Adrenochrom. (Screenshot: t3n

5. Telegram: Kein Widerspruch mehr

Eine besondere, wenn auch noch wenig erforschte Rolle für die Verbreitung von Verschwörungserzählungen spielt der Messenger Telegram. In den beliebig großen Kanälen können Verschwörungsideologen Youtube-Links, Links zu Facebook-Gruppen oder eigene Inhalte zu teilen. Der QAnon-Kanal „Qlobal Change“ beispielsweise zählt über 120.000 Abonnenten.

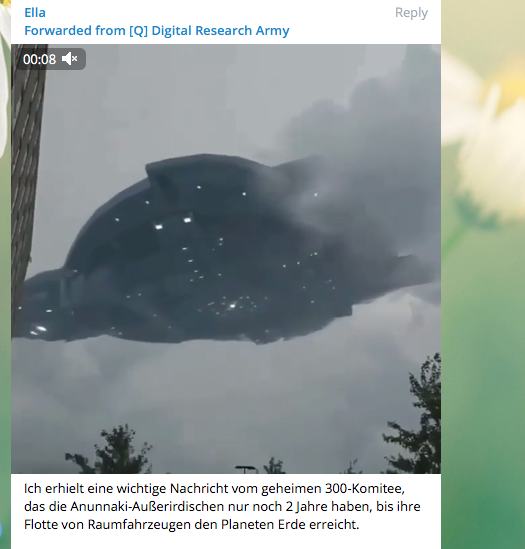

Weil Telegram selbst so gut wie nicht moderiert, blühen dort auch Missinformationen zur Covid-19-Pandemie auf. Das besondere an Telegram-Kanälen: Oft können nur die Administratoren posten – und ihre vermeintlichen „Beweise“ oder Links zu Verschwörungserzählungen bleiben unkommentiert stehen. Viele der bekannteren Verschörungsideologen mischen dabei auch private Inhalte in ihre Kanäle. Nutzer bekommen dadurch das Gefühl, die Administratoren zu kennen, und vertrauen ihnen eher. Experten sprechen dabei von parasozialen Beziehungen.

In einer QAnon-Gruppe wird davor gewarnt, dass Außerirdische nur noch zwei Jahre von der Erde entfernt seien – dazu gibt es ein Video von einem Raumschiff. (Screenshot: t3n)

Die Algorithmen der sozialen Netzwerke und Suchmaschinen sind natürlich nicht allein an der Verbreitung von Verschwörungsideologien Schuld. Aber gerade für die Ausbreitung von QAnon scheinen sie einen wichtigen Beitrag zu leisten.

Wenn man auf Demos QAnon-Gläubige wie James, den Eventbauer aus Köln, fragt, wie sie zu ihren Wahrheiten über Q und Trump und den angeblichen Friedensvertrag kommen, fällt eine Antwort besonders auf: „Es ist alles da, man muss nur mal danach suchen.“

[Verwandte oder Freunde von dir glauben an Verschwörungserzählungen? In diesem Artikel erklären die Expertinnen Katharina Nocun und Pia Lamberty, wie du ihnen am besten helfen kannst.]

- QAnon: Warum Menschen an die bizarre Verschwörungstheorie glauben

- Verschwörungstheorien, soziale Medien und Influencer: Eine toxische Kombination?

- Radikalisierung auf Telegram: Nazis, Waffen, Drogen und Attila Hildmann

- Warum ist das Netz so rechts? Diese Extremismus-Forscherin kennt die Antwort

- Generation Newsfeed: Wie groß ist die Schuld von Facebook an der Polarisierung wirklich?

Es ist geschenen, was nie hätte geschehen dürfen – Dumme Menschen vereinen sich über Digitale Kanäle.

Frage halt, wie man damit umgehen mag?

Immerhin liefern diese „Gläubigen“ eben ein Wahnsinns-Potenzial über Religion nachzudenken. Vergleicht mal die Muster, nur wird sich dort niemand trauen vorzupreschen…

Dumme Menschen sind in erster Linie die, die alles ohne zu hinterfragen glauben, was Regierung und Medien ihnen servieren.

Deutschland ist zu einem sozialistischen Scheixhaus verkommen, in dem linke Gewalt heruntergespielt und der Islam hofiert werden. Da diese beiden gewalttätigen Ausrichtungen immer mehr deutsche Opfer fordern, wird es auch immer größeren Widerstand geben gegen diese Ungerechtigkeit.

Puh… Wo soll man da anfangen…? Schwierig…

Ein Arzt mit Spritze und ein Richter mit Unterbringungsbescheid könnten helfen.

War ja klar, dass wieder ein ungebildeter Linkspopulist in Erscheinung tritt, der keine Argumente, sondern nur Beleidigungen aufbringt.

Tschüss Titus, solche Menschen wie du werden gerade in den USA massiv bekämpft und weggesperrt, demnächst auch in Deutschland.

Oje, meine Typo ist nicht besser…

Man kann natürlich auch die Verschwörungstheorien der Regierung glauben, dass die Rente sicher ist, dass unter den Flüchtlingen keine Terroristen sind, dass nur Mädchen von Moria geholt werden usw.

Je mehr Lügen die Regierung präsentiert und je mehr die an deren Tropf hängenden Medien (220 Mio. Euro Bestechungsgelder) ihrer Pflicht als 4. Gewalt im Staat nicht nachkommen, umso mehr Menschen werden erwachen und sich von den Lügenden abwenden.

Wieso bestätigst du das Bild was eh schon Untermauert wird…

Was hat Rente mit Verschwörung zu tun?

Wer sagt dass kein Flüchtling ein Terrorist ist/wird?

Es werden hier absolute Werte von Ihnen in den Raum gestellt, ohne Nuancen. Es kann nie etwas 100% vorrausgesagt werden, und das tut auch keiner, außer vielleicht populistische Politiker.

Ich weiß nicht wo Sie so etwas gelesen haben.

Zu den Medien kann ich nur sagen, dass egal was ich Ihnen jetzt hier nennen werde, Sie mir wahrscheinlich eh nicht glauben werden. Wenn man seine Informationen von 4Chan/8Chan (QAnon), dubiosen Bloggern und US-republikanisch angehauchten Seiten hat, ist es mir nur zu versändlich, wie Sie so ein Weltbild haben können. Es wird Angst und Hass geschürt. Ich will Ihnen hier nicht unterstellen, sich nicht weitreichend genug informiert zu haben, aber vermutlich weitreichend in bloß eine Richtung. Meine bottom line ist hier, Quellen zu glauben, deren Hintergrund/Absicht mindestens so dubios und zweifenhaft ist (hier sei noch einmal QAnon/4Chan genannt), wie man sie der „Mainstream Media“ unterstellt, sollte sich noch einmal Gedanken machen, wieso man einer Quelle mehr glauben schenkt als der anderen. Ich sage nicht, dass ich immun gegen Manipulation bin, besonders nicht in Zeiten von Social Media, aber ich weiß, dass ich gerne beide Seiten ansehe, und (so wie ich glaube) sie sehe, für was sie stehen.

Aussagen, dass unter den Flüchtlingen keine Terroristen sein werden (vor dem Islamischen Attentat vom Breitscheidplatz) finden sich hier: https://www.google.com/search?ie=UTF-8&client=ms-android-samsung&source=android-browser&q=keine+Terroristen+unter+Flüchtlingen

De Maiziere, Merkel & Co. haben Menschen geopfert.

Da ich jetzt den Beweis für meine Aussage angetreten habe, ist die Linke Bubble geplatzt.

Wenns nach dem Internet geht, sind alle Ausländer Terroristen und alle Deutschen Nazis. Es ist genau das was fehlt, das viele graue dazwischen.

Ich kenn jemanden der behauptet in Deutschland gäbe es plotische Morde die als Verkehrunfälle getarnt sind. Das hat er bereits vor Internet gemacht.

Leider ist der Artikel stark geframt, sehr beliebig und wenig differenziert.

QAnon: Glauben Kinder würden entführt etc. spricht erstmal die eigene Moralvorstellung dagegen (wie generell bei Kindemissbrauch), dafür könnte die enorme Anzahl der Kinder sprechen, die jedes Jahr als vermisst gemeldet werden allein in den Industrieländern. Ich glaube es nicht, mir wäre aber wohler, wenn ich wüsste, dass es nicht stimmt.

Querdenker: möchten einen breiten wissenschaftlichen Diskurs bei Covid (warum 1,5m oder in Bayern 2m Abstand wo die WHO doch nur 1m vorgibt, warum Masken im freien im Gegensatz zur WHO, warum wir die von der WHO angenommene Metastudie von Ioannidis mit einer Sterblichkeit für Covid 19 im Bereich der Grippe nicht berücksichtigt, wie rechtfertigt man PCR Tests z.B. bei Symptomlosen, die danach als infiziert gelten (positiver Test) obgleich jedem bekannt sein muss, dass der Test nicht für medizinische Diagnostik gemacht/geeignet und zugelassen ist (steht auf jeder Packung), darüber hinaus unabhängige Gerichte (aktuell nicht gegeben), mehr Einfluss für die Bürger, nicht nur alle vier Jahre bei einer Wahl (imperatives Mandat, der Wahlkreis kann den Politiker jederzeit abberufen) etc. sind einige Punkte dabei die ich auch ganz gut finde, ich muss aber nicht alles mögen.

Coronaleugner: spricht manches dafür (z.B. wurde Virus noch nie unter einem Elektronenmikroskop in gereingter Form fotografiert), vieles dagegen. Aber wen interessierts, das wäre als wenn jemand behaupten würde dieser oder jener Verein der 2. Liga ist der spielersich beste Club der Welt.

Ich finde es bedenklich, wenn Menschen eine abweichende Meinung nicht mehr aushalten wollen (ein sachlicher Diskurs ist nicht mehr möglich) und durch Zensur die Meinungsfreiheit eingeschränkt wird (was in extremen Masse auch FB und YT passiert), natürlich nicht zu verwechseln mit Aufruf zur Gewalt, Straftaten und anheuern von Terroristen, etc.