Auch Apple wagt sich an generative Sprach-KI und betritt damit – so formulierte es CEO Tim Cook – „Neuland“. Dafür investiert der Konzern täglich Millionen von Dollar in die Forschung – das nun vorgestellte KI-Modell ReaLM könnte Apple Siri alltagstauglicher machen und damit zugleich auch schlauer. Eine Eigenschaft, die dem Sprachassistenten im Vergleich zur Konkurrenz fehlt.

ReaLM: Apples KI-Modell könnte Referenzauflösung von Siri verbessern

Ein Team von Apples KI-Entwickler:innen um Joel Moniz und weiteren hat eine Forschungsarbeit mit dem Titel „ReALM: Reference Resolution As Language Modeling“ veröffentlicht. Diese beschreibt ein KI-Modell, das die Art und Weise, wie Nutzer:innen mit dem iPhone per Sprache interagieren, verbessert, indem es intuitive und kontextbezogene Antworten auf Anfragen ermöglicht.

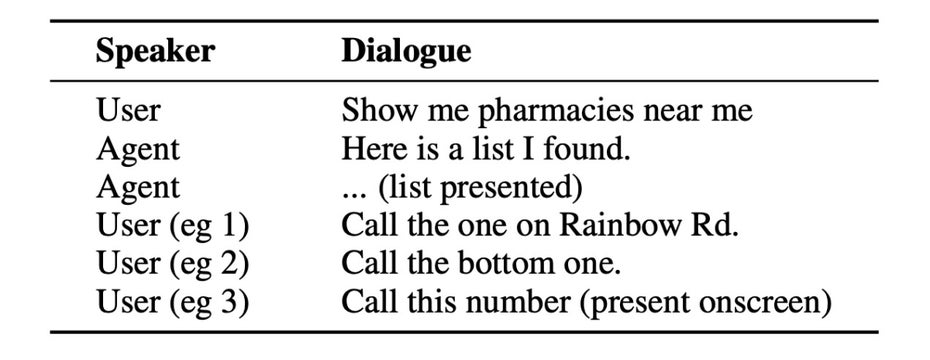

Laut des wissenschaftlichen Aufsatzes soll ReaLM beispielsweise mehrdeutige Verweise auf Bildschirmelemente sowie den Gesprächs- und Hintergrundkontext verstehen und so eine natürlichere Interaktion mit Sprachassistenten ermöglichen. Im Aufsatz wird in diesem Zusammenhang immer wieder von Referenzauflösung gesprochen, bei der eine KI bereits Gesagtes oder den Kontext eines Bildschirms bei einem weiteren Befehl berücksichtigt.

Mit dem KI-Modell ReALM könnte Siri kontextbezogene Befehle besser verstehen. (Screenshot: Apple)

Als Beispiel wird die KI per Sprachbefehl angewiesen, Apotheken in der Nähe anzuzeigen. Daraufhin wird dem Benutzer oder der Benutzerin eine entsprechende Liste angezeigt. Aus dieser kann mit verschiedenen natürlichsprachlichen Befehlen eine Apotheke ausgewählt und angerufen werden. Zum Beispiel: „Rufe die in der Regenbogenstraße an“ oder „Rufe die Unterste an“. Wenn auf dem Bildschirm nur eine Telefonnummer angezeigt wird, genügt es auch, dem Assistenten zu sagen, dass er diese anrufen soll.

Je nach Komplexität der angezeigten Informationen hätte die Ausführung der Befehle mit nahezu vollständiger Genauigkeit funktioniert, so die Forschenden.

Die Forschenden zeigen in ihrem Artikel aber nicht nur die Vorteile von ReaLM auf, sondern auch die Grenzen: So sei für komplexe Benutzeranfragen ein noch „nuancierteres Positionsverständnis“ notwendig. „Wir sind daher der Meinung, dass die Erforschung komplexerer Ansätze, wie die Aufteilung des Bildschirms in ein Raster und die Kodierung dieser relativen räumlichen Positionen in Text, zwar eine Herausforderung darstellt, aber ein vielversprechender Weg für zukünftige Untersuchungen ist“, so die Forschenden.

Apples ReaLM für die Ausführung auf dem Gerät entwickelt

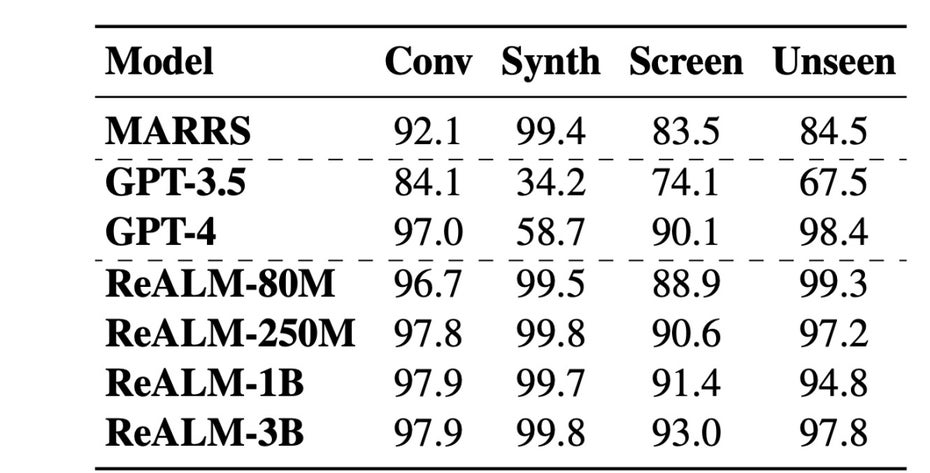

Die Forscher:innen geben an, dass das ReaLM-KI-Modell im Vergleich zu OpenAIs GPT-3.5 und GPT-4 unter anderem bei domänenspezifischen Abfragen akkuratere Resultate lieferte und im Vergleich zu GPT-4 weniger Rechenleistung erforderte. Außerdem sollen die größeren ReaLM-Modelle mit mehr Parametern GPT-4 deutlich übertroffen haben.

Apples KI-Modell ReaLM ist trotz geringerer Größe performant. (Screenshot: Apple)

Apple scheint sich bei dem KI-Modell in erster Linie auf den Einsatz direkt auf iPhones oder anderer Hardware zu konzentrieren. Zumindest heißt es in dem Artikel, dass AI die ideale Wahl für ein „praktisches Referenzauflösungssystem“ sei, das auf Geräten ohne Leistungseinbußen eingesetzt werden könne.

Die Vorteile eines On-Device-Modells liegen auf der Hand: Eine On-Device-Lösung wäre reaktionsschneller als eine Cloud-Lösung, zudem wäre die Privatsphäre besser geschützt. Gerade Letzteres ist für Apple ein sehr wichtiger Faktor, mit dem der Konzern regelmäßig wirbt.

Ältere Berichte gehen davon aus, dass Apple auf eine hybride Lösung setzt und einige KI-Aufgaben in die Cloud auslagert. Tatsächlich würde die Bereitstellung von KI-Modellen in der Cloud fortschrittlichere Operationen ermöglichen. Eine reine On-Device-Strategie erschwert es Apple zudem, seine KI-Modelle schneller zu aktualisieren und an eine sich rasch verändernde Branche anzupassen.

Apple hat im Laufe der letzten Monate mehrere KI-Forschungsarbeiten veröffentlicht. Im März hat das Unternehmen mit MM1 eine neue Methode für das Training großer Sprachmodelle vorgestellt, die sowohl Text als auch visuelle Informationen nahtlos integriert. Es wird allgemein erwartet, dass Apple auf der WWDC am 10. Juni eine Reihe von KI-Funktionen ankündigen wird – unter anderem für iOS 18.

Macht mit dem Gendern weiter. Ist mir sehr positiv aufgefallen, vielen Dank!

Und ich freue mich auch schon auf iOS 18.